En Resumen

- Perfusion es un modelo generador de imágenes IA creado por Nvidia de solo 100 KB de peso y 4 minutos de entrenamiento.

- La técnica "Key-Locking" propuesta por el proyecto evita el sobreajuste y ayuda a la IA a representar conceptos personalizados manteniendo su identidad.

- Perfusion permite a los usuarios controlar el equilibrio entre la fidelidad visual y la alineación textual sin necesidad de volver a entrenar la IA.

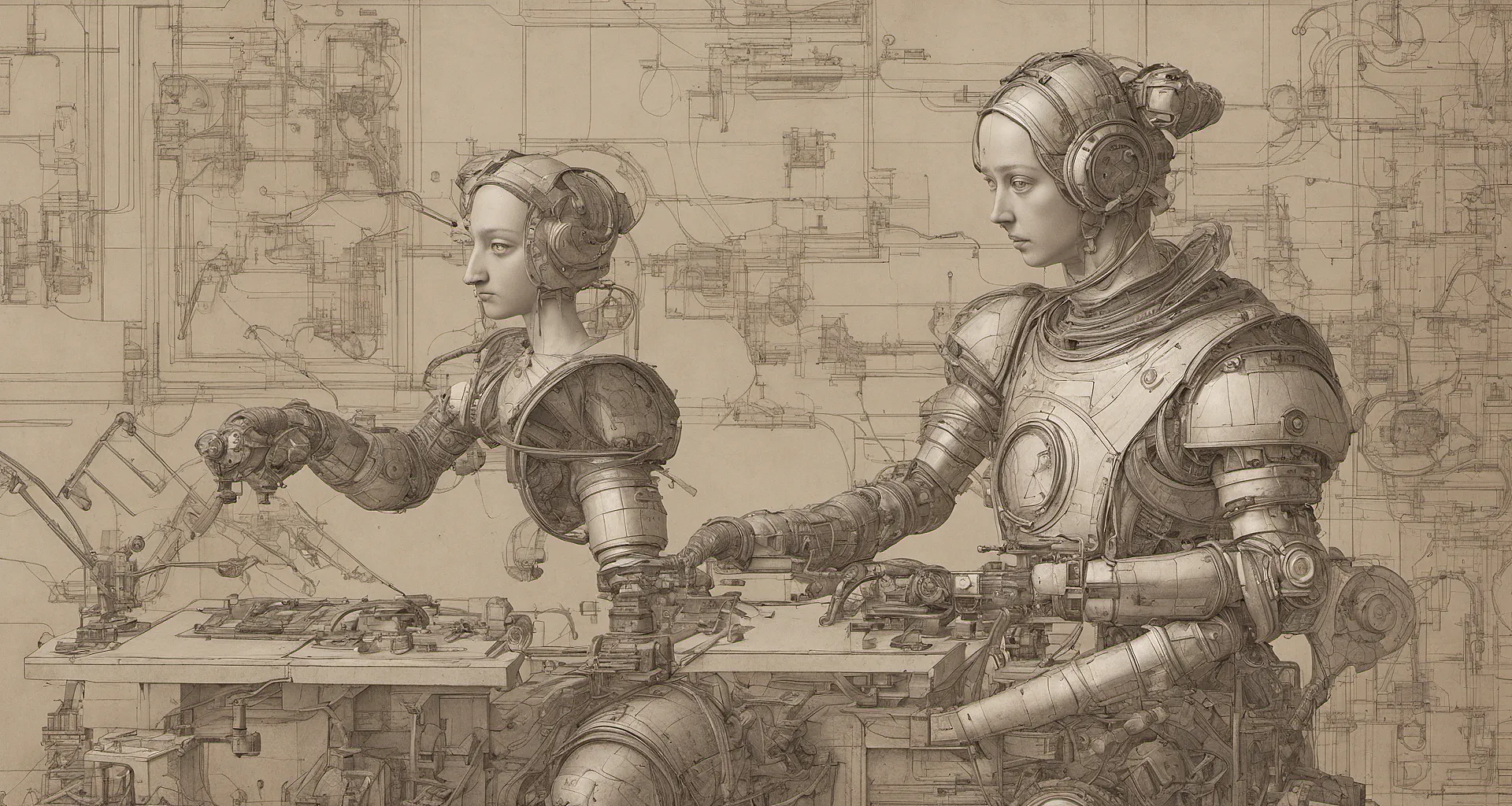

En el paisaje en constante evolución de las herramientas de creación de arte de IA, los investigadores de Nvidia han presentado un innovador método de personalización de texto a imagen llamado Perfusion. Pero no es un modelo superpesado de millones de dólares como los de sus competidores. Con un tamaño de solo 100 KB y un tiempo de entrenamiento de 4 minutos, Perfusion permite una gran flexibilidad creativa al retratar conceptos personalizados manteniendo su identidad.

Perfusion fue presentado en un artículo de investigación creado por Nvidia y la Universidad de Tel Aviv en Israel. A pesar de su pequeño tamaño, es capaz de superar a los principales generadores de arte de IA como Stability AI's Stable Diffusion v1.5, el recién lanzado Stable Diffusion XL (SDXL) y MidJourney en términos de eficiencia de ediciones específicas.

La idea principal en Perfusion se llama "Key-Locking", la cual funciona conectando nuevos conceptos que un usuario desea agregar, como un gato específico o una silla, a una categoría más general durante la generación de imágenes. Por ejemplo, el gato estaría vinculado a la idea más amplia de un "felino".

Esto ayuda a evitar el sobreajuste, que es cuando el modelo se ajusta demasiado estrechamente a los ejemplos de entrenamiento exactos. El sobreajuste dificulta que la IA genere nuevas versiones creativas del concepto.

Al vincular el nuevo gato a la noción general de un felino, el modelo puede representar al gato en muchas poses, apariencias y entornos diferentes. Pero aún conserva la esencia de "gato cariñoso" que hace que se parezca al gato deseado, y no a cualquier felino aleatorio.

Entonces, en términos simples, Key-Locking permite que la IA represente de manera flexible conceptos personalizados mientras mantiene su identidad central. Es como darle al artista las siguientes instrucciones: "Dibuja a mi gato Tom, mientras duerme, juega con estambre y huele flores".

Por qué Nvidia piensa que menos es más

Perfusion también permite combinar múltiples conceptos personalizados en una sola imagen con interacciones naturales, a diferencia de las herramientas existentes que aprenden conceptos de forma aislada. Los usuarios pueden guiar el proceso de creación de imágenes a través de indicaciones de texto, fusionando conceptos como un gato específico y una silla.

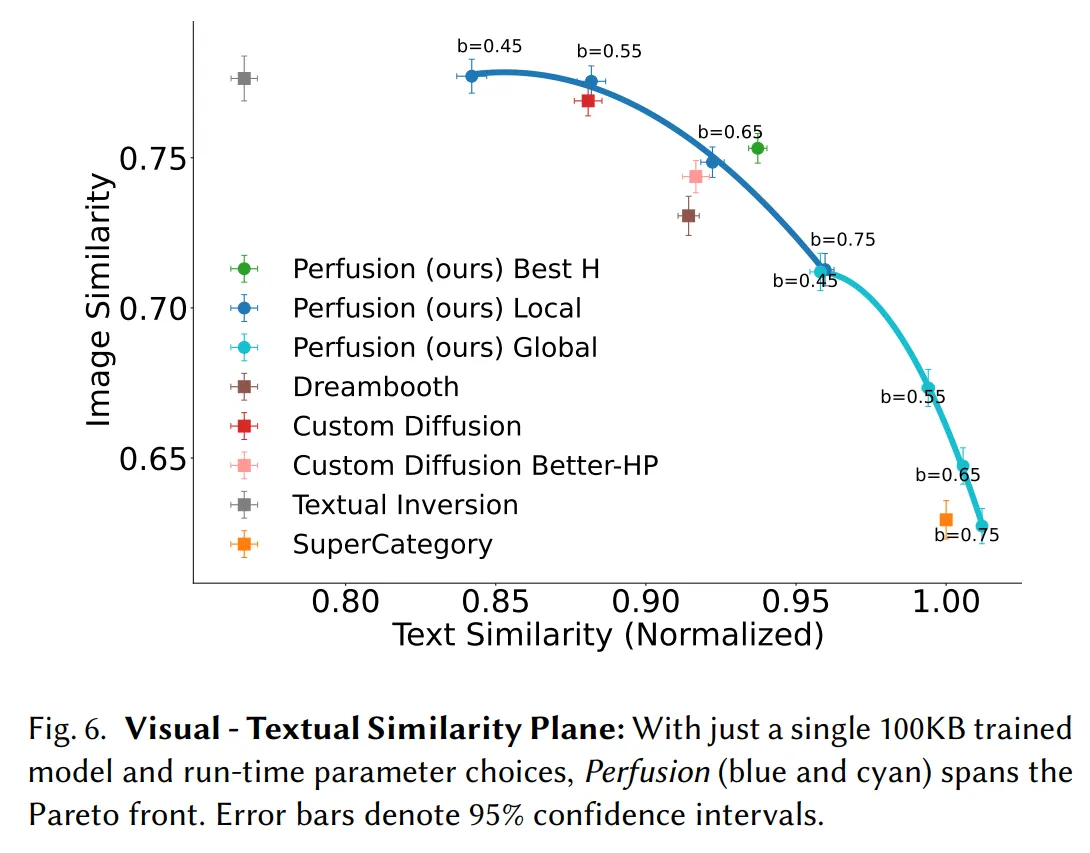

Perfusion ofrece una característica notable que permite a los usuarios controlar el equilibrio entre la fidelidad visual (la imagen) y la alineación textual (la indicación) durante la inferencia ajustando un solo modelo de 100KB. Esta capacidad permite a los usuarios explorar fácilmente la frontera de Pareto (similitud de texto vs similitud de imagen) y seleccionar el compromiso óptimo que se adapte a sus necesidades específicas, todo sin necesidad de volver a entrenar.

Es importante tener en cuenta que entrenar un modelo requiere cierta habilidad. Centrarse demasiado en reproducir el modelo conduce a que produzca la misma salida una y otra vez, y hacer que siga la indicación demasiado de cerca, sin libertad, generalmente produce un mal resultado. La flexibilidad para ajustar qué tan cerca llega el generador a la indicación es una pieza importante de personalización.

Otros generadores de imágenes de IA tienen formas para que los usuarios ajusten la salida, pero son voluminosos. Como referencia, una LoRA es un método popular de ajuste fino utilizado en Stable Diffusion. Puede agregar desde decenas de megabytes hasta más de un gigabyte (GB) a la aplicación. Otro método, las incrustaciones de inversión textual, son más livianas pero menos precisas. Un modelo entrenado utilizando Dreambooth, la técnica más precisa en este momento, pesa más de 2GB.

En comparación, Nvidia dice que Perfusion produce una calidad visual y alineación superiores a las indicaciones en comparación con las técnicas de IA líderes mencionadas anteriormente. El tamaño ultraeficiente permite actualizar solo las partes que necesita cuando ajusta cómo produce una imagen, en comparación con la huella de varios GB de los métodos que ajustan finamente todo el modelo.

Esta investigación se alinea con el creciente enfoque de Nvidia en IA. Las acciones de la compañía han aumentado más del 230% en 2023, ya que sus GPUs continúan dominando el entrenamiento de modelos IA. Con entidades como Anthropic, Google, Microsoft y Baidu invirtiendo miles de millones en IA generativa, el innovador modelo Perfusion de Nvidia podría darle una ventaja.

Por ahora, Nvidia solo ha presentado el documento de investigación, prometiendo lanzar el código pronto.