En Resumen

- El equipo de investigación en IA de Alibaba ha presentado "Animate Anyone", un modelo de IA que puede animar cualquier foto con notables consistencia y control.

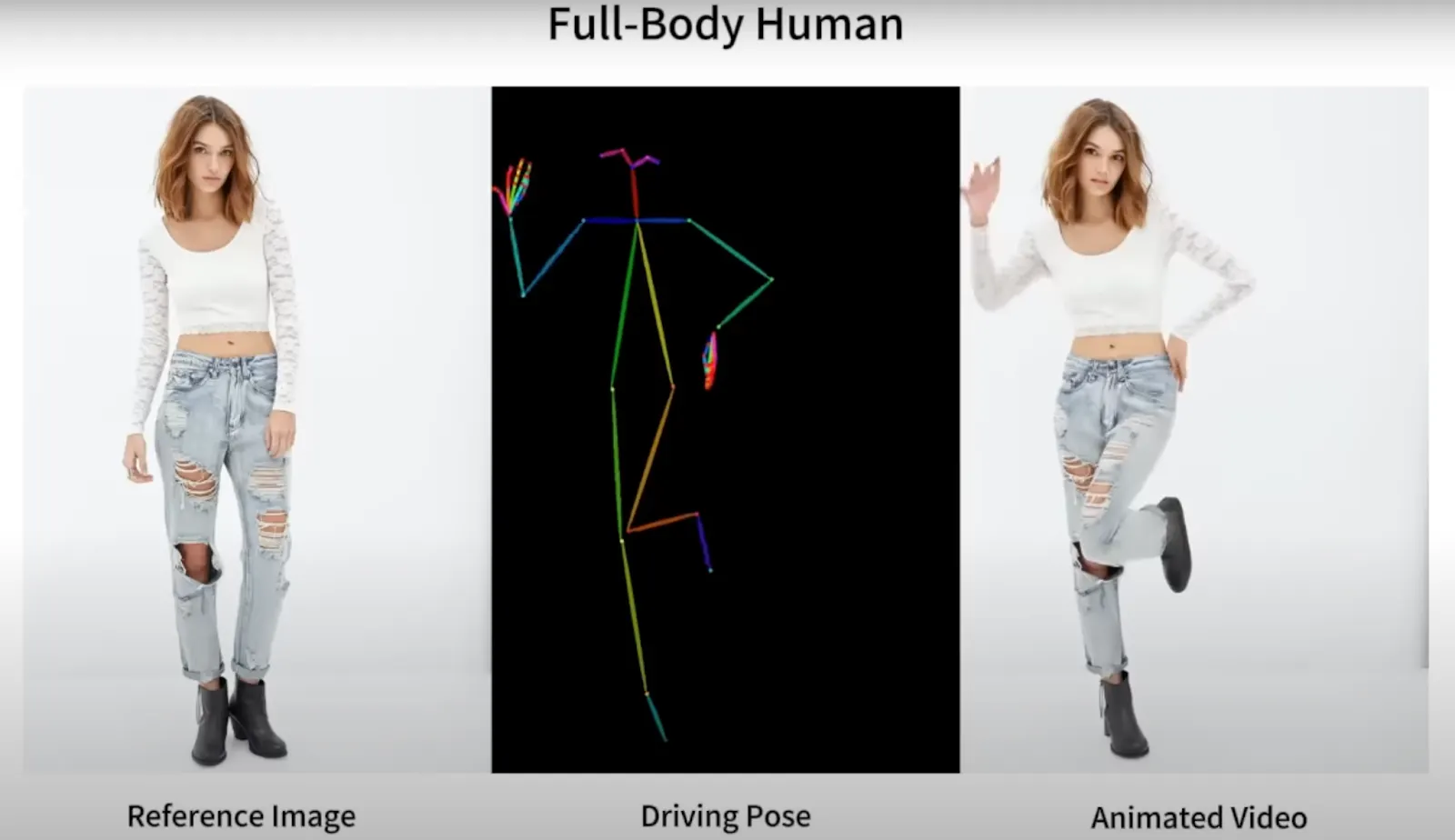

- Según Alibaba, Animate Anyone puede transformar fotos en videos "controlados por secuencias de poses deseadas y logrando continuidad temporal".

- La tecnología utiliza modelos de difusión integrados en un nuevo marco llamado ReferenceNet, que fusiona características detalladas a través de la atención espacial. El resultado es una animación casi perfecta que mantiene la apariencia del personaje de referencia.

- El modelo Animate Anyone se compara favorablemente con otras herramientas de animación, como AnimateDiff, Warpfusion, Deforum y ebSynth.

Hemos recorrido un largo camino desde Adobe Flash y las tarjetas electrónicas animadas de JibJab.

Dos décadas después, las personas con computadoras y un poco de tiempo libre pueden crear animaciones de alta calidad (tanto de personas reales como de ilustraciones) con solo unos clics y sin conocimientos de edición digital.

Esa es la propuesta, al menos, de "Animate Anyone", un modelo de IA presentado por el equipo de investigación en IA de Alibaba, una empresa tecnológica multinacional china especializada en comercio electrónico y tecnología minorista. Y el video de su tecnología en acción, que afirma poder animar cualquier foto con una notable consistencia y control, ha capturado la imaginación de millones de personas.

Alibaba dice que Animate Anyone puede transformar fotos en videos "controlados por secuencias de poses deseadas y logrando continuidad temporal", explicó la startup de avatares de IA MyCompanions en Twitter. "Menos fallas y sin dedos extra, ¡bastante genial!"

El equipo agrega que esta tecnología abre puertas para nuevos casos de uso entre los influencers: ropa generada por IA y la creación de un mercado de videos personalizados pero producidos en masa.

La página de GitHub del modelo fue inundada con solicitudes de acceso al código fuente. En respuesta, el equipo ha asegurado al público que hará la demostración y el código disponibles en una fecha aún no especificada.

"Gracias a todos por su increíble apoyo e interés en nuestro proyecto", dijo el equipo en la última actualización de Github del proyecto. "Queremos asegurarles que estamos trabajando activamente en la preparación de la demostración y el código para su lanzamiento público".

La declaración recibió más de 240 me gusta en menos de un día.

Si la demostración en video es precisa, Animate Anyone se puede utilizar para crear resultados de videos claros y temporalmente estables mientras se mantiene la apariencia del personaje de referencia.

Esto parece ser el resultado de la integración de modelos de difusión en un nuevo marco llamado ReferenceNet, que puede fusionar características detalladas a través de la atención espacial.

Para lograr esto, se toma la imagen de referencia, se mueven las partes para seguir la pose deseada y luego se rellenan los espacios que deben ser llenados para dar la ilusión de movimiento constante para cada fotograma del video generado. La llamada secuencia de openpose resulta en una animación casi perfecta.

Animate Anyone también está siendo comparado favorablemente con otras herramientas populares de animación como AnimateDiff, Warpfusion, Deforum y ebSynth. Estas herramientas existentes a menudo no logran generar fotogramas consistentes, lo que hace fácil identificar los videos como generados por IA. En contraste, Animate Anyone produce una salida más refinada, donde los fotogramas son consistentes y la animación es casi indistinguible de la realidad.

El equipo de Animate Anyone no ha respondido a una solicitud de comentarios de Decrypt.

Sin embargo, en medio del frenesí, ha surgido un modelo similar llamado MagicAnimate como un competidor sólido. Recientemente disponible para pruebas locales, MagicAnimate adopta un enfoque ligeramente diferente para el proceso de animación. Aunque no es tan popular, su lanzamiento ofrece una alternativa para aquellos interesados en explorar más a fondo el mundo de la animación impulsada por IA.

A diferencia de Animate Anyone, que también utiliza un modelo de difusión, pero se centra en la animación coherente en cuadros y controlable a partir de imágenes, el diferenciador de MagicAnimate es mejorar la coherencia temporal y la preservación de la identidad.

Según se informa, su codificador de apariencia única y su técnica de fusión de video conducen a transiciones más suaves en animaciones de video largas y una mejor preservación de detalles en los cuadros.

Sin embargo, aunque MagicAnimate destaca en coherencia temporal y calidad por cuadro, no parece ser tan preciso como su competidor.

El ex investigador de Meta AI, Alex Carliera, tuvo la oportunidad de probar MaticAnimate, y aunque lo calificó como "un gran primer paso para la generación consistente de videos a partir de una sola imagen", señaló que las generaciones no eran 100% precisas en comparación con la imagen de referencia, deformando el cuerpo en algunos fotogramas.

Entonces, si no puedes bailar y te sientes excluido de las últimas coreografías de TikTok, tal vez Animate Anyone y MagicAnimate puedan ser tu boleto hacia el éxito viral.

Editado por Ryan Ozawa.

Daily Debrief Newsletter

Start every day with the top news stories right now, plus original features, a podcast, videos and more.