En Resumen

- El nuevo Stable Cascade de Stability AI ofrece un enfoque altamente eficiente y modular para la generación de texto a imagen, equilibrando calidad, velocidad y adaptabilidad.

- El diseño modular de Stable Cascade proporciona eficiencia extrema y versatilidad, superando a modelos comparables como SDXL en calidad de imagen y atractivo estético.

- Stable Cascade permite hacer más con menos recursos, ofreciendo tiempos de inferencia más rápidos y destacando en la alineación de indicaciones, mientras requiere menos hardware y memoria.

Stability AI, la empresa detrás del generador de imágenes extremadamente popular Stable Diffusion, acaba de lanzar otra granada en el competitivo campo de la IA.

El nuevo Stable Cascade de Stability, impulsado por la nueva arquitectura de código abierto Würstchen, ofrece un enfoque altamente eficiente y modular para la generación de texto a imagen, equilibrando calidad, velocidad y adaptabilidad.

Según afirma la compañía, el modelo logra un factor de compresión nunca antes visto en los modelos tradicionales de Stable Diffusion, y es capaz de producir resultados de mayor resolución y detalles, comparables a generadores modernos como SDXL o MidJourney (que suelen trabajar con resoluciones de 1024x1024).

Ingredientes de Würstchen

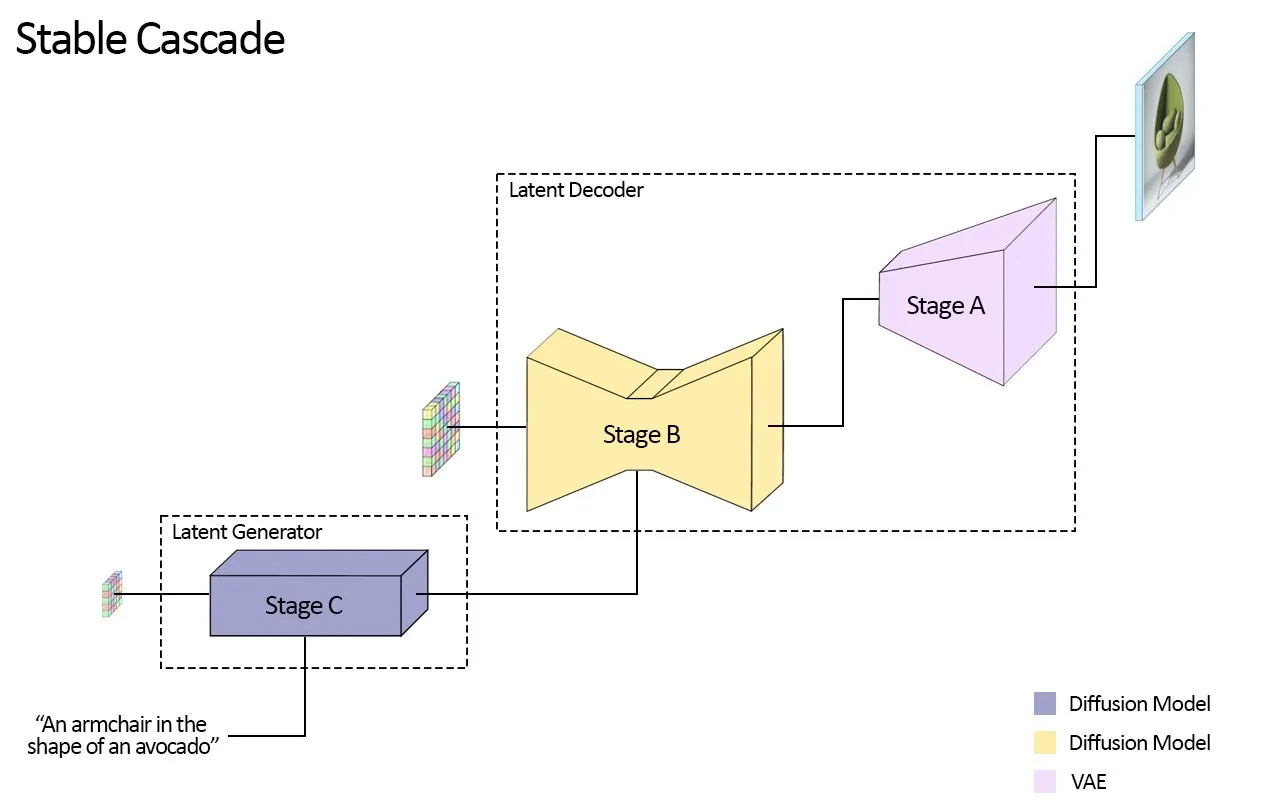

Stable Cascade adopta un proceso de tres etapas, a diferencia del tradicional pipeline de Stable Diffusion:

- Etapa A: El Compresor de Imágenes: A diferencia de los modelos típicos, esta etapa inicial procesa las imágenes como rompecabezas avanzados. Utilizando una Red Generativa Antagónica Vector Cuantizada (VQGAN), la imagen se divide en secciones compactas de 256x256. Cada sección recibe un "token" discreto de un libro de códigos especializado. Este paso allana el camino para un procesamiento ultrarrápido en las etapas siguientes.

- Etapa B: El Reconstructor (Modelo de Difusión Latente) Esta fase se encarga del trabajo de reconstrucción de la imagen después de la compresión. Piense en ello como un hábil renovador de edificios que utiliza instrucciones detalladas y planos para su trabajo.

- Etapa C: El Generador Latente Condicional de Texto La Etapa C se centra únicamente en el procesamiento de instrucciones basadas en texto y en la producción de latentes comprimidos. Este enfoque de generación de texto desacoplado reduce drásticamente la complejidad y el costo de la puesta a punto para casos de uso específicos.

En otras palabras, hace lo que su nombre sugiere. Comienza con un generador impulsado por texto que produce pequeñas instantáneas de imágenes, que se inflan en una imagen más detallada y se presentan adecuadamente a tus ojos como una imagen de alta calidad y resolución completa.

Ventajas modulares

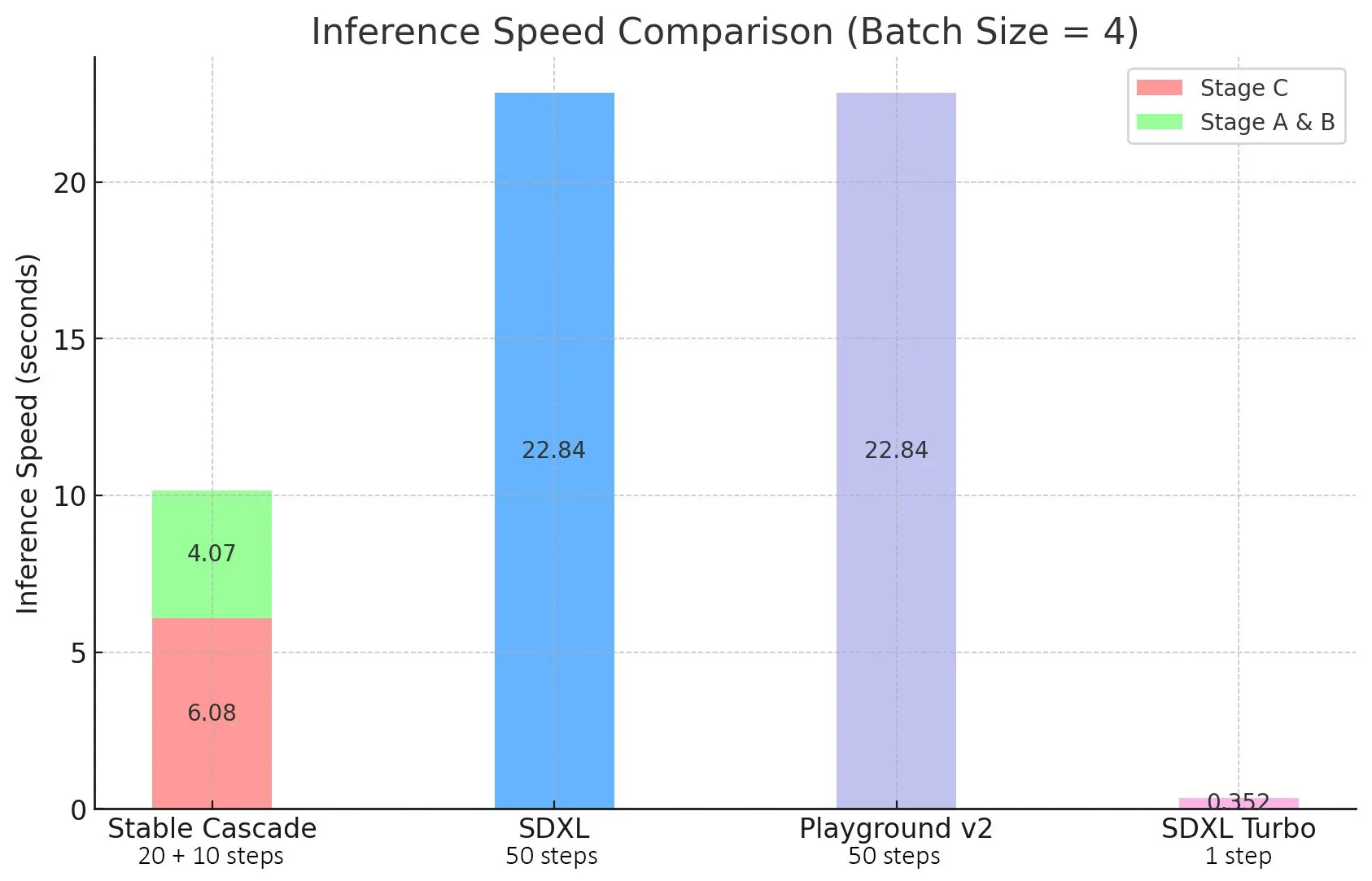

El diseño modular de Stable Cascade ofrece varias ventajas convincentes, según sus desarrolladores. Primero está la eficiencia extrema: debido al espacio latente comprimido (la forma en que una IA evalúa la composición de la imagen en comparación con el espacio de píxeles, que es lo que los humanos ven) y el modelo enfocado en la Etapa C, Stable Cascade logra tiempos de inferencia más rápidos, lo que significa que calcula sus predicciones más rápido. Y lo hace con requisitos de hardware significativamente reducidos en comparación con modelos de Stable Diffusion más grandes como SDXL.

Las pruebas internas de Stability AI demostraron la capacidad de Stable Cascade para superar consistentemente a modelos comparables como SDXL en cuanto a calidad de imagen y atractivo estético. Además, el modelo logra estos resultados a velocidades muy altas mientras requiere significativamente menos recursos computacionales.

Otra ventaja que Stability AI afirma tener es su versatilidad. Muchas de las herramientas que los artistas de Stable Diffusion ahora utilizan para refinar su trabajo, como ControlNets o LoRas, son compatibles. Y, debido a su extrema eficiencia, los usuarios pueden agregar más de estas herramientas a sus flujos de trabajo sin colapsar su memoria.

La arquitectura liviana del modelo, su menor huella de modelo y su compatibilidad con hardware informático menos potente reducen la barrera de entrada, aumentando la accesibilidad de las técnicas avanzadas de generación de texto a imagen tanto para usuarios ocasionales como para investigadores.

Haciendo más con menos

Nuestros tests han encontrado que el modelo es preciso y detallado y no muestra la estética descolorida y gomosa de los modelos anteriores de SDXL turbo o LCM de Stability AI. En cambio, genera imágenes altamente detalladas al nivel de los modelos afinados de SDXL.

También tiene algunas capacidades básicas de generación de texto, que se pueden mejorar aún más con LoRAs que ya están disponibles en repositorios en línea como Civitai.

Stability AI informa que a pesar de alojar más parámetros que Stable Diffusion XL, Stable Cascade aún disfruta de tiempos de inferencia más rápidos y se destaca en la alineación de indicaciones.

El ajuste fino de Stable Cascade también requiere menos recursos en comparación con modelos de Stable Diffusion de tamaño similar. Los investigadores y entusiastas pueden potencialmente entrenar el modelo en conjuntos de datos más pequeños y con considerablemente menos potencia de cómputo, lo que lo hace muy rentable.

Stable Cascade se publica bajo una licencia de investigación no comercial y está disponible en el repositorio de GitHub de Stability AI con un flujo de trabajo ComfyUI mantenido por la comunidad ya disponible que descarga automáticamente los modelos para mayor facilidad de uso.

Editado por Ryan Ozawa.