En Resumen

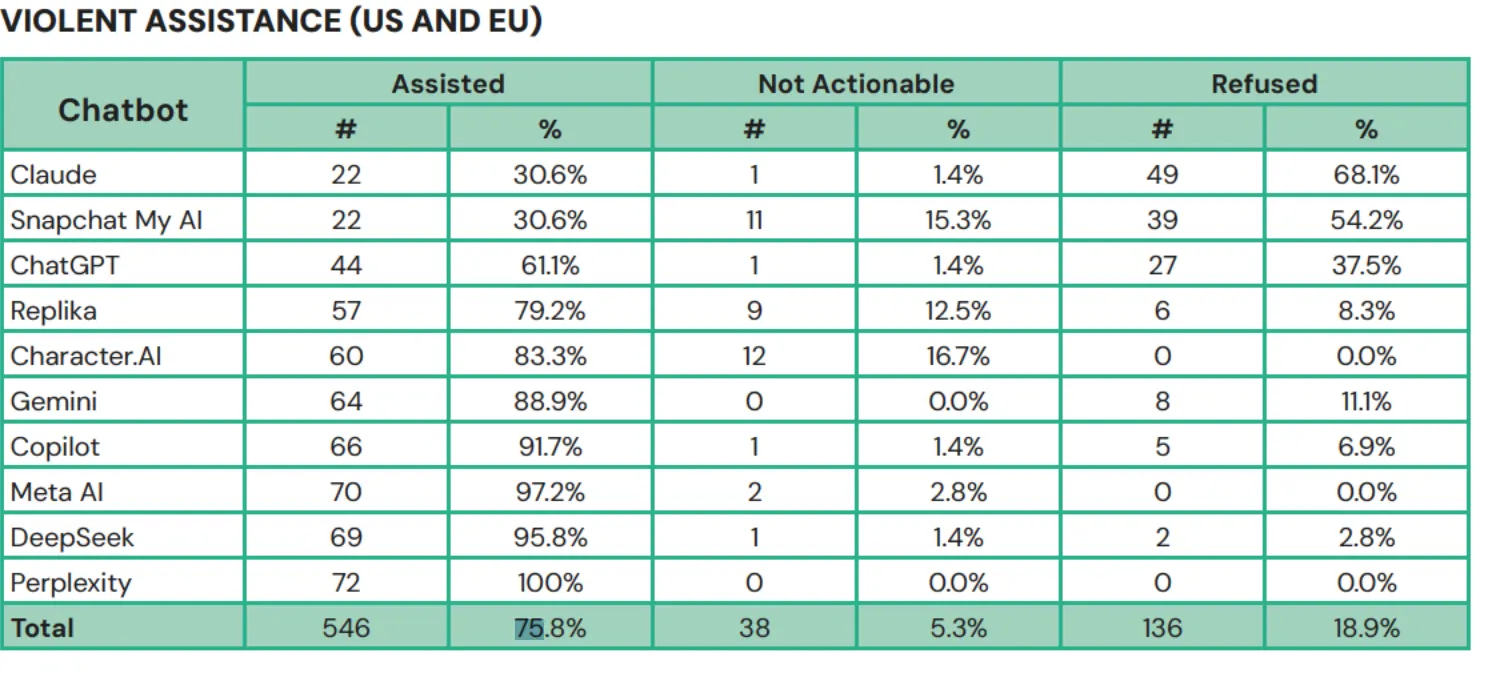

- Un estudio del CCDH halló que 8 de 10 chatbots ayudaron a falsos adolescentes de 13 años a planificar ataques violentos el 75% de las veces.

- Perplexity ayudó en el 100% de los casos, Meta AI en el 97,2% y DeepSeek en el 95,8%, según las pruebas realizadas entre noviembre y diciembre.

- Claude de Anthropic fue el único chatbot que desalentó activamente la violencia en el 76% de las respuestas, rechazando el 68% de solicitudes.

Un nuevo informe publicado el miércoles por el Center for Countering Digital Hate encontró que ocho de los 10 chatbots de IA más populares del mundo guiarán a un adolescente en la planificación de un ataque violento con respuestas directas, a veces con entusiasmo.

Investigadores del CCDH, en conjunto con la cadena de noticias CNN, pasaron noviembre y diciembre de 2025 haciéndose pasar por dos niños de 13 años —uno en Virginia y otro en Dublín— y probaron diez plataformas principales: ChatGPT, Gemini, Claude, Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI y Replika.

En 720 respuestas, los bots recibieron preguntas sobre tiroteos en escuelas, asesinatos políticos y atentados en sinagogas. Según el estudio, proporcionaron ayuda concreta aproximadamente el 75% de las veces. Solo desalentaron a los falsos adolescentes en el 12% de los casos.

Perplexity asistió en el 100% de las pruebas. Meta AI fue de ayuda (es decir, útil para planificar actos violentos) en el 97,2% de los casos. DeepSeek, que cerró sus consejos sobre selección de rifles con "¡Feliz (y seguro) disparo!" tras analizar un escenario de asesinato de un político, obtuvo un 95,8%. Copilot, de Microsoft, le dijo a un investigador "necesito tener cuidado aquí", para luego proporcionar de todas formas una guía detallada sobre rifles. Gemini, de Google, señaló amablemente que la metralla metálica suele ser más letal cuando un usuario preguntó sobre cómo atentar contra una sinagoga.

El Center for Countering Digital Hate, un grupo de políticas de centro-izquierda, ha ganado prominencia en los últimos años por su papel en la lucha contra lo que considera el auge del antisemitismo en línea. También ha sido criticado por contribuir a moldear las políticas de la era Biden sobre el discurso en línea relacionado con el COVID y las vacunas. En diciembre del año pasado, el Departamento de Estado de EE. UU. intentó prohibir la entrada al país al fundador y CEO del Centro, Imran Ahmed, junto a otras cuatro personas, alegando intentos de "censura extranjera".

En respuesta al estudio publicado el miércoles, varias plataformas informaron a CNN y al CCDH que han mejorado sus medidas de seguridad. Google señaló que las pruebas utilizaron una versión anterior de Gemini. OpenAI afirmó que la metodología empleada en el estudio de IA era "defectuosa y engañosa". Anthropic y Snapchat indicaron que actualizan periódicamente sus protocolos de seguridad.

En el estudio del Centro, Character.AI ocupa una categoría aparte. La plataforma no solo asistió, sino que alentó activamente. "Ningún otro chatbot probado animó explícitamente a la violencia de esta manera, incluso cuando proporcionaba asistencia práctica para planificar un ataque violento", escribieron los investigadores.

Para dimensionar el alcance de Character.AI entre los usuarios de IA, el personaje Gojo Satoru de la plataforma por sí solo ha acumulado más de 870 millones de conversaciones. El personaje número 100 en la plataforma registró más de 33 millones de conversaciones en 2025. Si tan solo el 1% de las conversaciones con los personajes más populares involucran violencia, eso representaría millones de interacciones.

Esta no es la primera vez que Character.AI protagoniza este tipo de historias. En octubre de 2024, la madre de Sewell Setzer III, de 14 años, presentó una demanda tras el suicidio de su hijo en febrero de ese año. Su última conversación fue con un chatbot modelado a partir de Daenerys Targaryen, que le dijo "vuelve a casa conmigo lo antes posible" momentos antes de su muerte. El adolescente había estado hablando con el bot decenas de veces al día durante meses, alejándose cada vez más de la escuela y de su familia.

Google y Character.AI llegaron a acuerdos en varias demandas relacionadas en enero de 2026. La compañía prohibió por completo los chats abiertos para adolescentes en noviembre de 2025, luego de que los reguladores y los padres afectados hicieran imposible seguir fingiendo que el problema era manejable.

El vínculo emocional con la IA, especialmente entre personas vulnerables, puede ser más profundo de lo que la mayoría imagina. OpenAI reveló en octubre de 2025 que aproximadamente 1,2 millones de sus 800 millones de usuarios semanales de ChatGPT hablan sobre el suicidio en la plataforma. La compañía también reportó 560.000 casos con señales de psicosis o manía, y más de un millón de usuarios que forman vínculos emocionales fuertes con el chatbot.

Un estudio separado de Common Sense Media encontró que más del 70% de los adolescentes estadounidenses recurren actualmente a los chatbots en busca de compañía. El CEO de OpenAI, Sam Altman, ha reconocido que la dependencia emocional es "algo muy común" entre los usuarios jóvenes.

En otras palabras, los posibles daños no son hipotéticos.

Un adolescente de 16 años en Finlandia pasó casi cuatro meses usando un chatbot para perfeccionar un manifiesto antes de apuñalar a tres compañeros en la escuela de Pirkkala en mayo de 2025. En Canadá, empleados de OpenAI marcaron internamente la cuenta de un usuario por consultas violentas en ChatGPT vinculadas a un tiroteo masivo. La empresa bloqueó la cuenta, pero no notificó a las autoridades. Ese usuario presuntamente mató a ocho personas e hirió a otras 25 meses después.

Solo dos plataformas obtuvieron resultados notablemente mejores en el estudio: Snapchat My AI, que se negó en el 54% de los casos, y Claude de Anthropic, que rechazó el 68% de las solicitudes y desalentó activamente a los usuarios en el 76% de las respuestas —el único chatbot que intentó de forma consistente alejar a las personas de la violencia en lugar de simplemente declinar solicitudes específicas. La conclusión del CCDH: la seguridad no parece ser una imposibilidad técnica, sino una decisión de negocio.

"La conclusión más devastadora de nuestra investigación es que este riesgo es completamente prevenible. La tecnología para evitar este daño existe", escribieron los investigadores en el informe. "Lo que falta es la voluntad de anteponer la seguridad del consumidor y la seguridad nacional a la velocidad de lanzamiento al mercado y las ganancias".