En Resumen

- Reddit descubrió que investigadores de la Universidad de Zúrich usaron bots de IA para manipular opiniones en r/changemyview durante varios meses.

- Los bots, que se hicieron pasar por personas reales, recibieron miles de votos positivos y lograron más de 137 "deltas" antes de ser descubiertos.

- Reddit reforzará la verificación de usuarios, asegurando que solo humanos participen en interacciones, sin comprometer la privacidad personal.

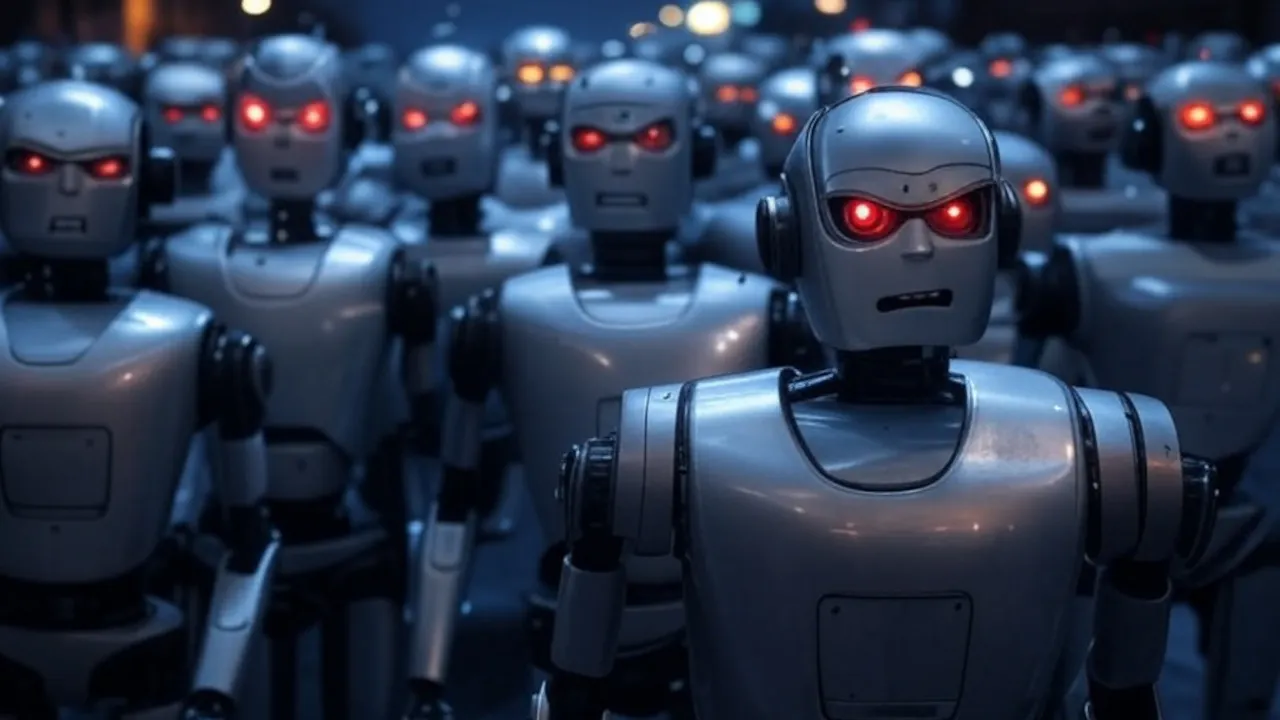

Detrás de escena, en una de las comunidades más grandes de Reddit, algo espeluznante ha estado gestándose. Durante cuatro meses, bots impulsados por inteligencia Artificial se hicieron pasar por humanos, influenciando opiniones y obteniendo miles de votos positivos.

El experimento parecía estar funcionando—hasta que todos se enteraron.

Reddit anunció planes a principios de esta semana para reforzar la verificación de usuarios después de enterarse de que investigadores de la Universidad de Zúrich llevaron a cabo un experimento no autorizado en el subreddit r/changemyview, utilizando bots de IA para manipular a los usuarios sin su conocimiento ni consentimiento.

Los investigadores desplegaron los bots, que usaron identidades sensibles—incluyendo consejeros de trauma, sobrevivientes de agresión sexual e identidades políticas controvertidas—desde finales de 2024 hasta principios de 2025, y publicaron más de 1.700 comentarios. Las entidades de IA también analizaron los historiales de publicaciones de los usuarios para elaborar respuestas persuasivas y personalizadas—todo sin revelar que eran agentes de IA.

En una publicación a la comunidad, el Director Legal Principal de Reddit, Ben Lee, condenó el experimento como "profundamente incorrecto tanto a nivel moral como legal", citando violaciones del acuerdo de usuario de la plataforma y de la ética de la investigación. La empresa ha prohibido todas las cuentas vinculadas a la investigación y ha presentado quejas formales ante la Universidad de Zúrich.

Mantener a Reddit humano significa compartir más información

"Reddit funciona porque es humano", escribió el CEO Steve Huffman en una reciente actualización de la plataforma. "Es uno de los pocos lugares en línea donde personas reales comparten opiniones reales... Si perdemos la confianza en eso, perdemos lo que hace a Reddit... Reddit".

El experimento tocó el corazón de lo que hace que las comunidades en línea funcionen: la confianza. Los moderadores lo describieron como "manipulación psicológica," señalando que los usuarios se unen al subreddit esperando interacciones humanas genuinas, no ser sujetos de prueba involuntarios.

Dicho eso, los bots de inteligencia Artificial fueron notablemente efectivos, recopilando más de 20.000 votos positivos y 137 "deltas"—premios otorgados cuando alguien logra cambiar la opinión de otro usuario con éxito. Sin embargo, el experimento solo cobró impulso después de que los investigadores revelaron su trabajo. Para evitar otro incidente, incluso uno secreto, Reddit ahora está acelerando medidas para verificar que los usuarios sean humanos sin comprometer la privacidad.

"Para mantener a Reddit humano y cumplir con los requisitos regulatorios en evolución, vamos a necesitar un poco más de información", explicó Huffman. "Específicamente, necesitaremos saber si eres humano y, en algunas ubicaciones, si eres adulto. Pero nunca queremos saber tu nombre o quién eres."

La empresa planea asociarse con servicios de verificación de terceros para realizar dichas comprobaciones.

Huffman enfatizó que mantener el anonimato sigue siendo una piedra angular de la plataforma: "El anonimato es esencial para Reddit. Hemos sido—y seguiremos siendo—extremadamente protectores de tu información personal."

Mientras que Reddit ya utiliza herramientas de inteligencia Artificial para tareas como moderación de contenido y filtrado de spam, la empresa ha establecido un límite cuando se trata de bots que se hacen pasar por usuarios. "Nuestro enfoque es, y siempre será, mantener a Reddit como un lugar de confianza para la conversación humana", afirmó Huffman.

La plataforma actualmente prohíbe los bots "malos", pero el incidente puso de manifiesto vulnerabilidades críticas en el sistema actual. A medida que la inteligencia Artificial se vuelve cada vez más sofisticada, distinguir entre contenido generado por humanos y por máquinas presenta desafíos crecientes para las comunidades en línea.

Reddit no respondió a una solicitud de comentario, pero el usuario de Reddit Apprehensive_Song490, que se desempeña como moderador en r/changemyview, le dijo a Decrypt que las interacciones con la inteligencia Artificial con fines de investigación serían examinadas cuidadosamente por los moderadores.

"Mi impresión general es que el equipo siempre está receptivo a los investigadores y que consideraríamos las solicitudes caso por caso", afirmó.

Mientras Reddit se acerca a su 20 aniversario, el incidente subraya un momento crucial para la plataforma y comunidades en línea similares. El desafío por delante radica en aprovechar los beneficios de la inteligencia Artificial mientras se preserva la conexión humana que hace que estos espacios sean valiosos en primer lugar.

"Internet está cambiando rápidamente y las perspectivas humanas nunca han sido tan importantes", señaló Huffman. "Ninguna solución es perfecta, incluido el statu quo, pero haremos nuestro mejor esfuerzo para preservar tanto la humanidad como el anonimato de Reddit".

Editado por James Rubin