En Resumen

- OpenAI presentó Sora, un nuevo modelo de IA capaz de crear videos basados en texto.

- Sora busca mejorar la consistencia en videos de un minuto, un desafío en el espacio de IA.

- Aunque Sora ofrece imágenes cautivadoras, aún enfrenta desafíos de fidelidad y censura.

OpenAI presentó Sora, un nuevo modelo de inteligencia artificial que puede tomar instrucciones basadas en texto y crear videos largos y cautivadores. Bueno, videos de un minuto de duración.

Actualmente, es una versión beta cerrada, disponible solo para desarrolladores invitados, y representa una entrada algo tardía por parte del líder mundial en IA. La conversión de texto a video no es exactamente un territorio inexplorado. Empresas como RunwayML y Pika Labs han estado en el juego durante un tiempo y actualmente dominan la escena con modelos capaces de crear imágenes impresionantes en segundos.

Pero siempre hay un inconveniente: estos videos tienden a ser cortos, la historia pierde enfoque y coherencia a medida que se alargan.

Con Sora, OpenAI busca lograr consistencia, generando videos detallados de un minuto de duración que pueden fluir y evolucionar sin problemas. No es una meta sencilla, ya que los modelos de IA improvisan cada cuadro desde cero. Un pequeño defecto en un solo cuadro puede convertirse en una cascada de alucinaciones e imágenes irreales.

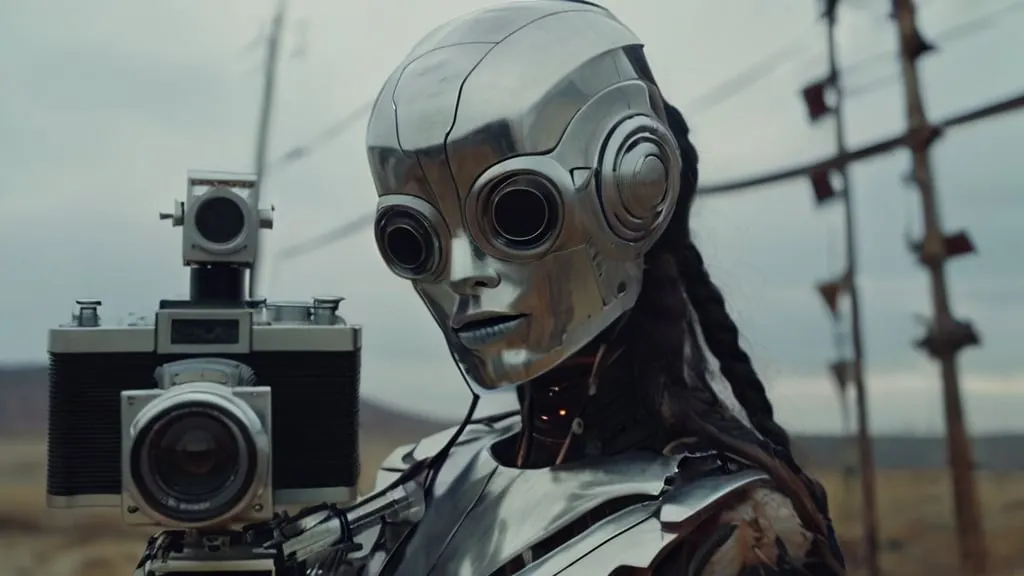

OpenAI parece haber avanzado, con Sora demostrando imágenes suaves y cautivadoras que hasta ahora no tienen rival entre los actores actuales en el espacio. OpenAI publicó algunos videos de ejemplo en línea, y algunos han sido republicados de manera no oficial en YouTube.

OpenAI se enfrenta a otras compañías de IA que también están probando el nuevo ecosistema de los videos generativos. El popular generador de texto a imagen Midjourney anunció recientemente que está trabajando en un generador de texto a video, pero no ofreció una fecha de lanzamiento. Además, Stability AI recientemente causó sensación con Stable Video Diffusion, su oferta de código abierto capaz de generar videos de 25 cuadros con una resolución de 576x1024.

Incluso Meta está mostrando su generador de video EMU, como parte de su impulso para integrar la inteligencia artificial en las redes sociales y el metaverso.

Sora, que está en lanzamiento limitado por ahora, con OpenAI brindando acceso a "artistas visuales, diseñadores y cineastas" para recibir comentarios, se distingue por cómo comprende el lenguaje. Genera imágenes vibrantes y altamente detalladas mientras interpreta los matices de las indicaciones escritas. ¿Necesitas un movimiento de cámara específico? ¿Múltiples personajes con emociones realistas? No hay problema.

Sora incluso genera transiciones fluidas entre diferentes tomas dentro del mismo video, imitando lo que algunas herramientas de edición de video ya hacen hoy en día. Aquí hay otro video entusiasta publicado hoy en YouTube:

Sin embargo, la creatividad impulsada por la inteligencia artificial tiene sus peculiaridades. Sora aún no es un maestro cinematográfico. Pueden surgir problemas con la física o con la causa y efecto intrincados. En otras palabras, y aunque ya es uno de los generadores de video más consistentes, no alcanza niveles de fidelidad absoluta, por lo que se pueden esperar alucinaciones.

Además, al provenir de OpenAI, es indudable que Sora será un modelo fuertemente censurado. La empresa enfatizó su enfoque en pruebas de seguridad y herramientas de detección para identificar contenido potencialmente dañino y engañoso. Sin embargo, OpenAI está trabajando con su equipo rojo para perfeccionar su modelo y espera que su estrategia de lanzamiento temprano conduzca a la colaboración en la construcción de una IA cada vez más segura en los próximos años.

Hasta ahora no se ha anunciado una fecha de lanzamiento inmediata para la implementación más amplia de Sora.

Editado por Ryan Ozawa.