En un mundo donde las noticias falsas se propagan a una velocidad vertiginosa, discernir la verdad de la ficción es cada vez más difícil. Y a pesar de las innumerables horas de trabajo y millones de dólares invertidos en proyectos y políticas destinados a promover el periodismo veraz, la situación sigue lejos de ser ideal, y eso fue antes de que la inteligencia artificial (IA) pudiera ser utilizada para crear imágenes falsas de aspecto realista.

De hecho, según el Supervisor Europeo de Protección de Datos, las noticias falsas se consideran libertad de expresión, y combatir la desinformación es casi imposible porque "la pura masa de fake news (noticias falsas) difundidas en las redes sociales no puede ser manejada manualmente".

Afortunadamente, y de manera apropiada, la inteligencia artificial también puede desempeñar un papel en la desenmascarar las noticias falsas, sin importar cómo se generen. Este poder proviene principalmente del explosivo crecimiento de grandes modelos de lenguaje como GPT-4.

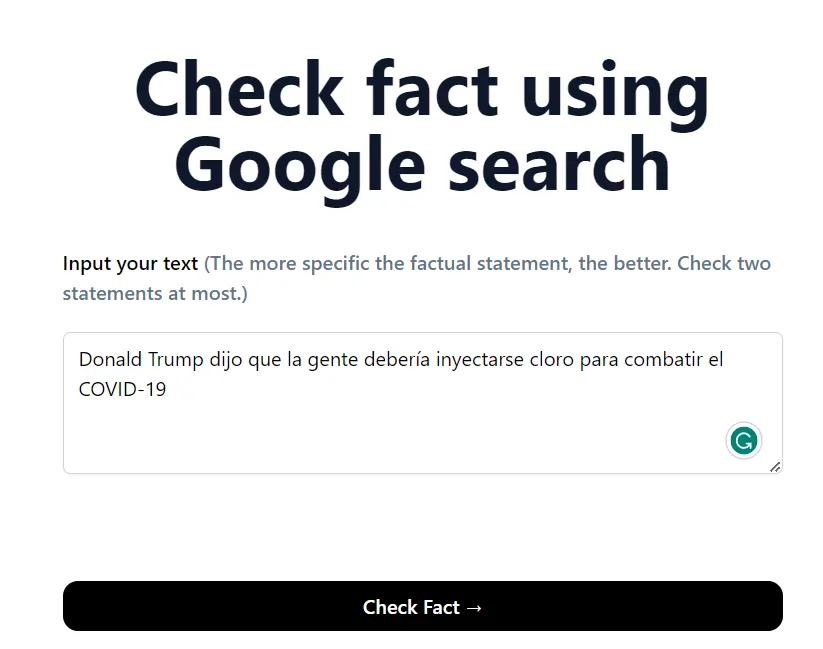

Por ejemplo, desarrolladores anónimos han lanzado AI Fact Checker, una herramienta creada para utilizar la inteligencia artificial (IA) para verificar hechos. Una vez que un usuario ingresa una afirmación en el verificador, la plataforma busca fuentes confiables en Internet, analiza los datos y compara esa información con la afirmación proporcionada. Luego determina si la afirmación o el hecho es verdadero (true), falso (false) o poco claro (unclear) y proporciona fuentes para respaldar sus conclusiones.

Decrypt probó la funcionalidad de la herramienta y demostró un nivel de precisión del 100% al verificar hechos recientes, eventos históricos e información variada. Sin embargo, cuando se trataba de consultar noticias sobre los precios de bienes, servicios y vehículos de inversión, la herramienta tropezó y comenzó a confundir las noticias de predicción con el comportamiento real de los precios.

Otras herramientas de IA están dirigidas al mismo problema: las Herramientas de Verificación de Hechos de Google, Full Fact y FactInsect se encuentran entre las más reconocidas. Incluso hay alternativas descentralizadas como Fact Protocol y la ahora desaparecida Civil. Pero una alternativa comienza a destacar del resto debido a su facilidad de uso y precisión: el navegador y motor de búsqueda impulsado por IA de Microsoft.

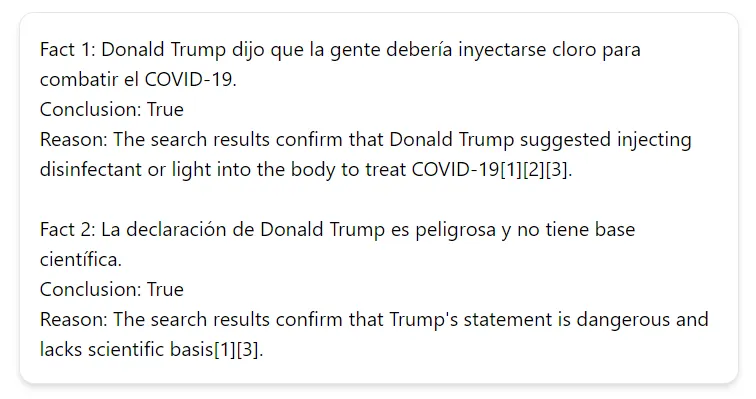

El gigante del software ha integrado GPT-4 en su navegador Edge, brindando a los usuarios un bot de IA al alcance de sus dedos. A diferencia de ChatGPT (que no puede buscar en la web información y tiene un conjunto de datos fijo anterior a 2021), el nuevo Bing con GPT-4 puede navegar por la web, por lo que puede proporcionar respuestas precisas y actualizadas al instante, proporcionando enlaces a fuentes confiables para cualquier pregunta, incluida la confirmación o refutación de un hecho dudoso.

Para verificar noticias falsas utilizando GPT-4 con Bing, simplemente descargue la última versión del navegador Edge y haga clic en el icono del logotipo de Bing en la esquina superior derecha. Se abrirá un menú lateral con tres opciones. Luego, seleccione la opción de Chat, pregunte lo que desea saber y la IA de Microsoft le dará la respuesta.

La IA impulsada por GPT de Microsoft valida el titular de Decrypt. No difundimos noticias falsas.

Los usuarios también pueden hacer clic en la opción de Insights, y la IA impulsada por GPT de Microsoft proporcionará información relevante sobre el sitio web que publica la noticia, incluidos los temas cubiertos, los temas relevantes, el tráfico de la página y la aclaración de las críticas comunes. A diferencia de la herramienta de verificación de hechos de IA, no proporciona una respuesta concreta que diga "esto es verdadero" o "esto es falso", pero proporciona suficiente información para llegar a una conclusión.

La otra cara de la moneda

Si bien la IA puede rastrear y comparar múltiples fuentes de información en cuestión de segundos, también existen riesgos asociados con el uso de algoritmos de IA para verificar noticias. Algunas limitaciones de la IA incluyen:

Entrenamiento en modelos defectuosos: Si un algoritmo de IA se entrena con datos inexactos o sesgados, su rendimiento podría verse afectado negativamente y producir resultados incorrectos. Asegurarse de que los datos utilizados para entrenar los algoritmos de IA sean precisos y representativos es crucial.

Alucinaciones de IA: Los algoritmos de IA pueden generar información que parece plausible pero no tiene una base real. Estas alucinaciones pueden llevar a conclusiones falsas al verificar noticias.

Vulnerabilidad a la manipulación: Los algoritmos de IA pueden ser susceptibles a ataques y manipulaciones, como la inserción de datos falsos o sesgados en su proceso de aprendizaje. Estos son algo equivalentes a un ataque del 51%, pero en un contexto de IA. Se utilizan un mayor número de refuerzos incorrectos, lo que hace que el modelo asuma que los datos incorrectos son verdaderos.

Artificial intelligence systems such as ChatGPT are susceptible to poisoning attacks. These types of attacks are relevant when threat actors attack training data sets, a proof-chain will eliminate such scenarios.

— Gummo (@GummoXXX) March 23, 2023

Esto es especialmente preocupante en modelos que dependen de la interacción humana o en modelos que están sujetos a una entidad central que los gestiona... lo que sucede exactamente con OpenAI y ChatGPT.