En Resumen

- Mistral lanzó Medium 3.5, un modelo de 128.000 millones de parámetros con funciones agénticas, pero la reacción en internet fue mayormente de decepción.

- El Qwen 3.6 de Alibaba, cuatro veces más pequeño, logra resultados similares en codificación y se distribuye gratis bajo Apache 2.0.

- La ventaja real de Mistral es geopolítica: es la única opción no estadounidense ni china para empresas europeas que exigen modelos auditables y autoalojables.

Mistral AI lanzó Mistral Medium 3.5 el 29 de abril. El laboratorio con sede en París anunció un modelo denso de 128.000 millones de parámetros, un conjunto de funciones agénticas, y chocó de frente con una ola de reacciones de "meh" en internet.

El lanzamiento llegó en tres partes. Primero, el modelo en sí. Segundo, agentes de codificación remotos a través de Mistral Vibe CLI, sesiones de codificación en la nube que pueden enviar pull requests a GitHub y ejecutarse en paralelo sin necesidad de estar frente a una terminal. Tercero, el Work Mode en Le Chat, la interfaz de consumo de Mistral al estilo ChatGPT, que ahora gestiona tareas autónomas de múltiples pasos como clasificación de correos electrónicos, síntesis de investigaciones y flujos de trabajo entre herramientas.

Grandes ambiciones, pero una realidad de benchmarks bastante confusa.

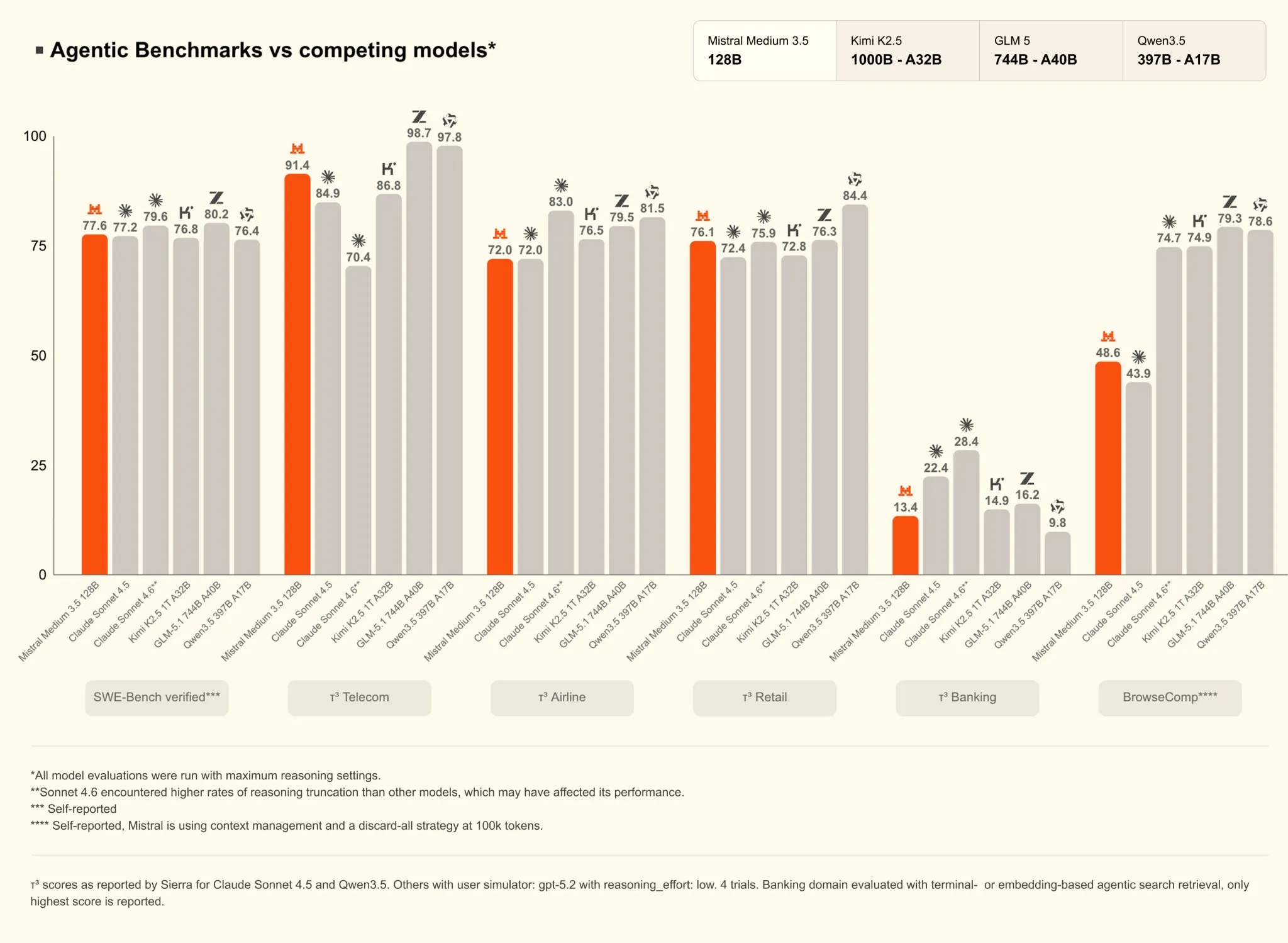

Medium 3.5 obtiene un 77,6% en SWE-Bench Verified, un benchmark de codificación que evalúa si un modelo puede corregir problemas reales de GitHub generando parches funcionales. También alcanza un 91,4% en τ³-Telecom, que mide el uso agéntico de herramientas en entornos especializados. Mistral también fusionó tres modelos que antes eran independientes (Medium 3.1, Magistral y Devstral 2) en un único conjunto de pesos con esfuerzo de razonamiento configurable por solicitud.

Unificar el modelo reemplazando a tres es un logro de ingeniería real. El problema es lo que cuesta y a quién se enfrenta.

Mistral cobra $1,50 por millón de tokens de entrada y $7,50 por millón de tokens de salida. El Qwen 3.6 de Alibaba, con 27.000 millones de parámetros, menos de una cuarta parte del recuento de parámetros de Medium 3.5, obtiene un 72,4% en el mismo benchmark SWE-Bench Verified y se distribuye bajo Apache 2.0, lo que significa que puedes descargarlo y ejecutarlo de forma gratuita.

¿Sabías?

Los parámetros determinan la capacidad de un modelo de IA para aprender, razonar y almacenar información. Cuantos más parámetros, mayor es la amplitud de conocimiento del modelo.

Al revisar los rankings de código abierto, el panorama es claro. Los primeros puestos pertenecen al Qwen de Alibaba, GLM de Zhipu AI de China y MiMo-V2 de Xiaomi, todos más económicos, potentes y competitivos que el nuevo lanzamiento de Mistral. Medium 3.5 ni siquiera ha aparecido en los principales rankings independientes, ya que las evaluaciones de terceros aún están pendientes.

Lo único positivo, según algunos, es que Mistral es, en este momento, el único modelo no chino con presencia real en la conversación sobre código abierto.

La Reacción de Internet

Pedro Domingos, profesor de machine learning en la Universidad de Washington, no fue nada condescendiente:

"Las empresas de IA normales presumen de cuánto mejor es su modelo en los benchmarks. Solo Mistral presume de cuánto peor es el suyo".

Luego planteó una pregunta más contundente: "No sé qué es peor, que Europa no esté en la carrera de la IA o que esté representada por un hazmerreír como Mistral".

Youssof Altoukhi, fundador de Yoyo Studios, hizo los cálculos: Qwen 3.6, con 27.000 millones de parámetros, es 4,7 veces más pequeño que Medium 3.5 y obtiene resultados comparables en codificación. El precio de salida de Medium 3.5 lo ubica al nivel de modelos cerrados que superan significativamente en todos los principales benchmarks.

"Si no fuera por su habilidad política, ya habrían quebrado", señaló.

No todos fueron simplemente desdeñosos. El desarrollador de IA Michal Langmajer capturó la ambivalencia:

"Me alegra genuinamente que todavía haya un laboratorio que no sea de EE. UU. ni chino intentando construir LLMs de frontera, pero Europa tiene que subir el nivel. Su nuevo modelo insignia básicamente 'no es el mejor' en ningún benchmark, y aun así cuesta varias veces más que la mayoría de los competidores".

Algunos desarrolladores argumentaron que los pesos abiertos son una apuesta por la durabilidad, no por el ranking. Un modelo que cualquiera puede descargar, ajustar y alojar por su cuenta no necesita ganar clasificaciones hoy para seguir siendo relevante. Otros señalaron los despliegues empresariales reales de Mistral en toda Europa como evidencia de que su ventaja competitiva no es puramente técnica.

La Red de Seguridad Geopolítica

Aquí es donde vive la propuesta real de Mistral.

Las empresas europeas sujetas al RGPD, los bancos que manejan datos sensibles de clientes y los gobiernos que no enrutarán cargas de trabajo de IA a través de infraestructura china tienen opciones limitadas. Según reportó Decrypt el pasado diciembre, HSBC firmó un acuerdo plurianual con Mistral específicamente para autoalojar los modelos en su propia infraestructura. El atractivo de un laboratorio de código abierto con sede en la UE y una valoración de $14.000 millones no aparece en las tablas de benchmarks, pero sí en las decisiones de compra.

No es el mejor en codificación ni el más económico. Pero sí es: no estadounidense, no chino, auditable, autoalojable y legalmente seguro para las empresas europeas.

Daily Debrief Newsletter

Start every day with the top news stories right now, plus original features, a podcast, videos and more.