En Resumen

- Google lanzó Veo 3.1 con capacidades de audio sincronizado y nuevas herramientas de edición, posicionándose como alternativa profesional frente a Sora 2 de OpenAI.

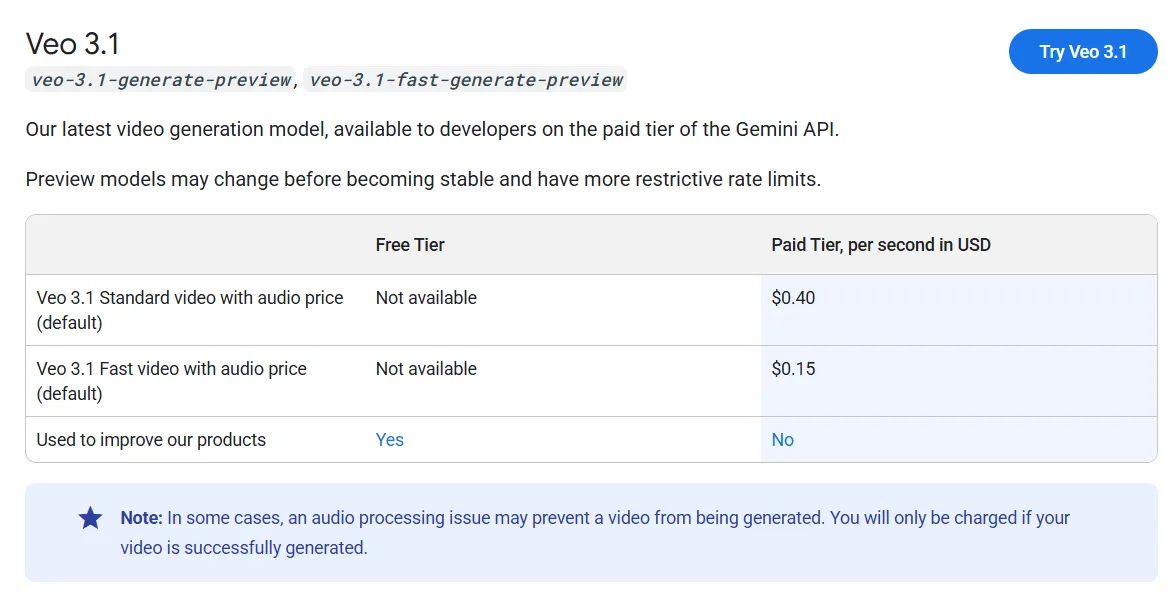

- El modelo cuesta $0,40 por segundo de video generado con audio a través de la API de Gemini, convirtiéndose en uno de los generadores más costosos del mercado.

- Veo 3.1 demostró ser superior en sincronización labial y coherencia de escenas, aunque presentó dificultades al mantener adherencia a imágenes de referencia.

Google lanzó Veo 3.1, una versión actualizada de su generador de videos con IA que agrega audio en todas las funciones e introduce nuevas capacidades de edición diseñadas para dar a los creadores más control sobre sus clips.

El anuncio llega mientras la aplicación competidora Sora 2 de OpenAI escala en las listas de las tiendas de aplicaciones y genera debates sobre el contenido generado por IA que inunda las redes sociales.

El momento sugiere que Google quiere posicionar a Veo 3.1 como la alternativa profesional al enfoque de feed social viral de Sora 2. OpenAI lanzó Sora 2 el 30 de septiembre con una interfaz estilo TikTok que prioriza compartir y remezclar.

La aplicación alcanzó 1 millón de descargas en cinco días y llegó al primer lugar en la App Store de Apple. Meta adoptó un enfoque similar, con su propia especie de redes sociales virtuales impulsadas por videos con IA.

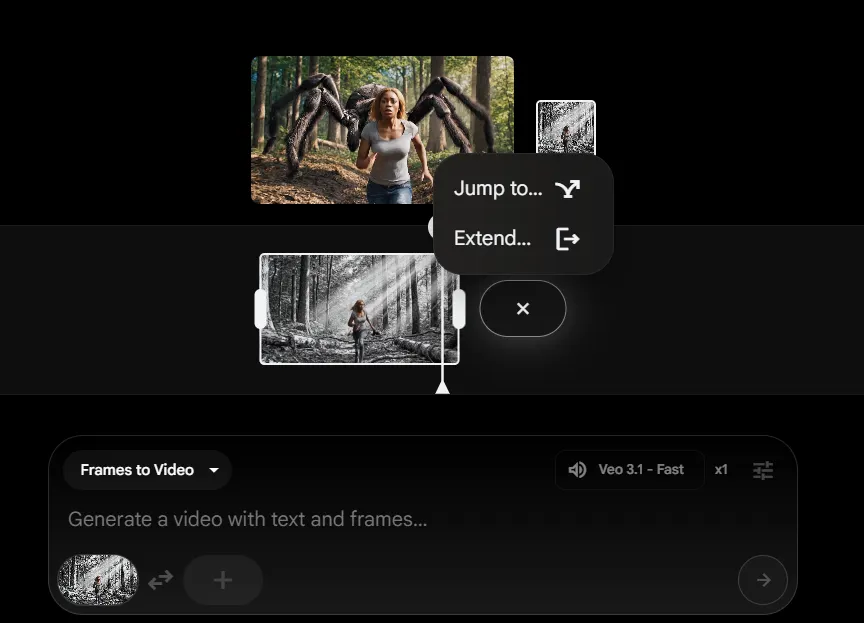

Los usuarios ahora pueden crear videos con ruido ambiental sincronizado, diálogo y efectos Foley usando "Ingredientes a Video", una herramienta que combina múltiples imágenes de referencia en una sola escena.

La función "Cuadros a Video" genera transiciones entre una imagen inicial y final, mientras que "Extender" crea clips que duran hasta un minuto al continuar el movimiento desde el último segundo de un video existente.

Las nuevas herramientas de edición permiten a los usuarios agregar o eliminar elementos de escenas generadas con ajustes automáticos de sombras e iluminación. El modelo genera videos en resolución 1080p en formatos de aspecto horizontal o vertical.

El modelo está disponible a través de Flow para uso del consumidor, la API de Gemini para desarrolladores y Vertex AI para clientes empresariales. Se pueden crear videos que duran hasta un minuto usando la función "Extender", que continúa el movimiento desde el último segundo de un clip existente.

El mercado de generación de videos con IA se ha saturado en 2025, con el modelo Gen-4 de Runway apuntando a cineastas, Luma Labs ofreciendo generación rápida para redes sociales, Adobe integrando Firefly Video en Creative Cloud, y actualizaciones de xAI, Kling, Meta y Google apuntando al realismo, generación de sonido y adherencia al prompt.

Pero, ¿qué tan bueno es? Probamos el modelo y estas son nuestras impresiones.

Probando el modelo

Si quieres probarlo, es mejor que tengas bolsillos profundos. Veo 3.1 es actualmente el modelo de generación de videos más costoso, a la par con Sora 2 y solo detrás de Sora 2 Pro, que cuesta más del doble por generación.

Los usuarios gratuitos reciben 100 créditos mensuales para probar el sistema, lo cual es suficiente para generar alrededor de cinco videos al mes. A través de la API de Gemini, Veo 3.1 cuesta aproximadamente $0,40 por segundo de video generado con audio, mientras que una variante más rápida llamada Veo 3.1 Fast cuesta $0,15 por segundo.

Para aquellos dispuestos a usarlo a ese precio, aquí están sus fortalezas y debilidades.

Texto a Video

Veo 3.1 es una mejora definitiva sobre su predecesor. El modelo maneja bien la coherencia y demuestra una mejor comprensión de los entornos contextuales.

Funciona en diferentes estilos, desde fotorrealismo hasta contenido estilizado.

Le pedimos al modelo que mezclara una escena que comenzaba como un dibujo y se transformaba en metraje de acción en vivo. Manejó la tarea mejor que cualquier otro modelo que probamos.

Sin ningún cuadro de referencia, Veo 3.1 produjo mejores resultados en modo texto a video que usando el mismo prompt con una imagen inicial, lo cual fue sorprendente.

El compromiso es la velocidad de movimiento. Veo 3.1 prioriza la coherencia sobre la fluidez, lo que hace difícil generar acción de ritmo rápido.

Los elementos se mueven más lentamente pero mantienen consistencia a lo largo del clip. Kling aún lidera en movimiento rápido, aunque requiere más intentos para lograr resultados utilizables.

Imagen a Video

Veo construyó su reputación en la generación de imagen a video, y los resultados aún se mantienen, con advertencias. Esta parece ser un área más débil en la actualización. Al usar diferentes formatos de aspecto como cuadros iniciales, el modelo tuvo dificultades para mantener los niveles de coherencia que alguna vez tuvo.

Si el prompt se aleja demasiado de lo que lógicamente seguiría a la imagen de entrada, Veo 3.1 encuentra una manera de hacer trampa. Genera escenas incoherentes o clips que saltan entre ubicaciones, configuraciones o elementos completamente diferentes.

Esto desperdicia tiempo y créditos, ya que estos clips no se pueden editar en secuencias más largas porque no coinciden con el formato.

Cuando funciona, los resultados se ven fantásticos. Llegar allí es parte habilidad, parte suerte, principalmente suerte.

Elementos a Video

Esta función funciona como inpainting para video, permitiendo a los usuarios insertar o eliminar elementos de una escena. Sin embargo, no esperes que mantenga una coherencia perfecta o use tus imágenes de referencia exactas.

Por ejemplo, el video a continuación fue generado usando estas tres imágenes de referencias y el prompt: un hombre y una mujer se topan entre sí mientras corren en una ciudad futurista, donde un holograma de un letrero de Bitcoin está rotando. El hombre le dice a la mujer: "¡RÁPIDO, BITCOIN SE DESPLOMÓ! ¡DEBEMOS COMPRAR MÁS!

Como puedes ver, ni la ciudad ni los personajes están realmente allí. Sin embargo, los personajes visten la ropa de referencia, la ciudad se asemeja a la de la imagen, y las cosas retratan la idea de los elementos, no los elementos en sí.

Veo 3.1 trata los elementos cargados como inspiración en lugar de plantillas estrictas. Genera escenas que siguen el prompt e incluyen objetos que se parecen a lo que proporcionaste, pero no pierdas tiempo tratando de insertarte en una película: no funcionará.

Una solución alternativa: usa Nanobanana o Seedream para cargar elementos y generar un cuadro inicial coherente primero. Luego alimenta esa imagen a Veo 3.1, que producirá un video donde personajes y objetos muestran una deformación mínima a lo largo de la escena.

Texto a Video con Diálogo

Este es el punto de venta de Google. Veo 3.1 maneja la sincronización labial mejor que cualquier otro modelo disponible actualmente. En modo texto a video, genera sonido ambiental coherente que coincide con los elementos de la escena.

El diálogo, la entonación, las voces y las emociones son precisos y superan a los modelos competidores.

Otros generadores pueden producir ruido ambiental, pero solo Sora, Veo y Grok pueden generar palabras reales.

De esos tres, Veo 3.1 requiere la menor cantidad de intentos para obtener buenos resultados en modo texto a video.

Imagen a Video con Diálogo

Aquí es donde las cosas se desmoronan. Imagen a video con diálogo sufre de los mismos problemas que la generación estándar de imagen a video. Veo 3.1 prioriza la coherencia tan intensamente que ignora la adherencia al prompt y las imágenes de referencia.

Por ejemplo, esta escena fue generada usando la referencia mostrada en la sección de elementos a video.

Como puedes ver, nuestra prueba generó un sujeto completamente diferente al de la imagen de referencia. La calidad del video fue excelente (la entonación y los gestos fueron perfectos), pero no era la persona que cargamos, lo que hace que el resultado sea inútil.

La función de remezcla de Sora es la mejor opción para este caso de uso. El modelo puede estar censurado, pero sus capacidades de imagen a video, sincronización labial realista y enfoque en tono, acento, emoción y realismo lo convierten en el claro ganador.

El generador de video de Grok viene en segundo lugar. Respetó mejor la imagen de referencia que Veo 3.1 y produjo resultados superiores. Aquí hay una generación usando la misma imagen de referencia y prompt.

Si no quieres lidiar con la aplicación social de Sora o no tienes acceso a ella, Grok podría ser tu mejor opción. También está sin censura pero moderado, así que si necesitas ese enfoque particular, Musk te tiene cubierto.