En Resumen

- Un hacker afirmó haber robado credenciales de 20 millones de cuentas de OpenAI y las puso a la venta en la dark web.

- OpenAI investiga el incidente, pero hasta ahora no ha encontrado evidencia de que sus sistemas hayan sido comprometidos.

- Algunos expertos en ciberseguridad dudan de la legitimidad del hackeo, señalando que algunas direcciones de correo en la muestra de datos eran inválidas.

OpenAI dice que está investigando los rumores después de que un hacker afirmara haber robado las credenciales de inicio de sesión de 20 millones de cuentas de usuario de la firma de IA, y las puso a la venta en un foro de la dark web.

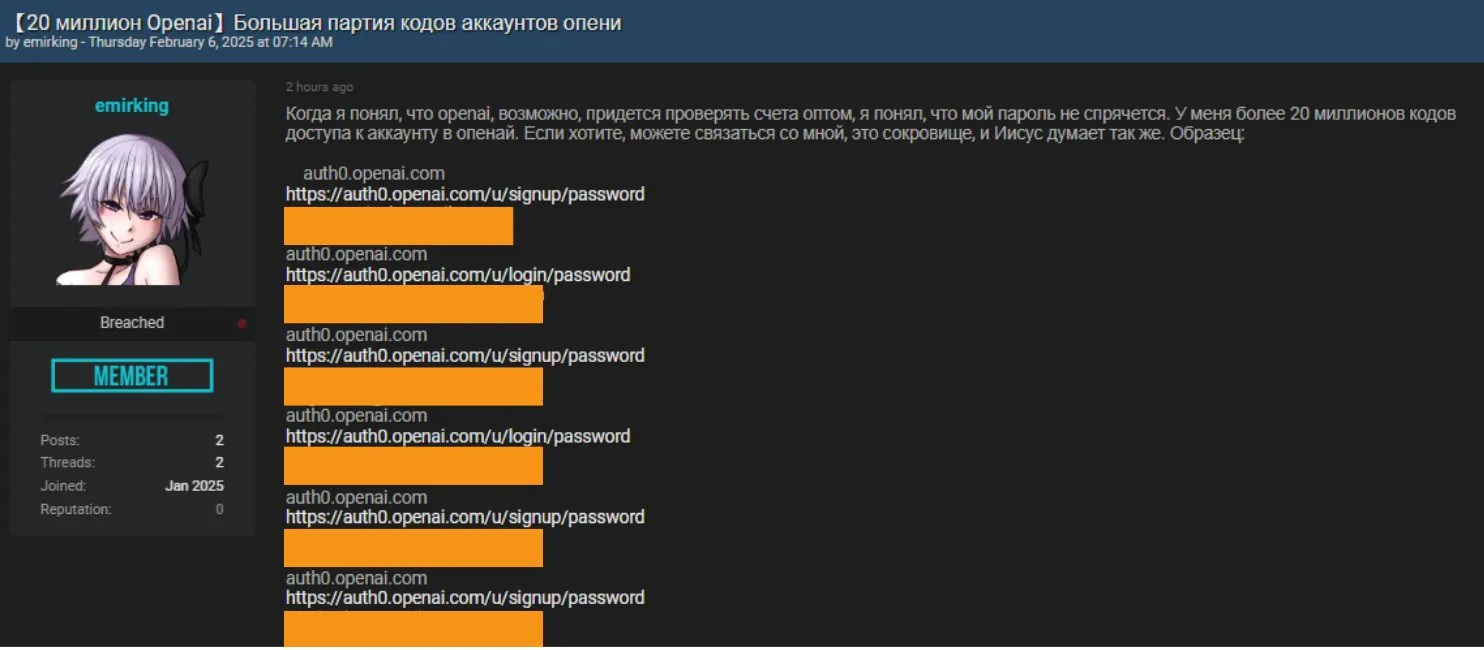

El hacker, que usaba un seudónimo, publicó un mensaje críptico en ruso anunciando "más de 20 millones de códigos de acceso a cuentas de OpenAI", calificándolo como una "mina de oro" y ofreciendo a posibles compradores lo que afirmaban ser datos de muestra que contenían direcciones de correo electrónico y contraseñas. Según lo informado por Gbhackers, el conjunto de datos completo se estaba ofreciendo en venta "por solo unos pocos dólares".

“Tengo más de 20 millones de códigos de acceso para cuentas de OpenAI,” escribió emirking el jueves, según una captura de pantalla traducida. “Si estás interesado, contáctame, esto es una mina de oro, y Jesús está de acuerdo.”

Si es legítimo, este sería el tercer incidente de seguridad importante para la empresa de inteligencia artificial desde el lanzamiento de ChatGPT al público. El año pasado, un hacker obtuvo acceso al sistema de mensajería interna de Slack de la empresa. Según The New York Times, el hacker "robó detalles sobre el diseño de las tecnologías de inteligencia artificial de la empresa."

Antes de eso, en 2023 un error más simple que involucra el jailbreaking provocó que los hackers obtuvieran los datos privados de los clientes de pago de OpenAI.

Sin embargo, esta vez, los investigadores de seguridad ni siquiera están seguros de que haya ocurrido un hackeo. El reportero de Daily Dot Mikael Thalan escribió en X que encontró direcciones de correo electrónico inválidas en los supuestos datos de muestra: "No hay evidencia que sugiera que esta presunta brecha de OpenAI sea legítima. Al menos dos direcciones eran inválidas. La única otra publicación del usuario en el foro es para un registro de robo. El hilo también ha sido eliminado desde entonces."

No evidence this alleged OpenAI breach is legitimate.

Contacted every email address from the purported sample of login credentials.

At least 2 addresses were invalid. The user's only other post on the forum is for a stealer log. Thread has since been deleted as well. https://t.co/yKpmxKQhsP

— Mikael Thalen (@MikaelThalen) February 6, 2025

OpenAI lo toma 'en serio'

En un comunicado compartido con Decrypt, un portavoz de OpenAI reconoció la situación mientras mantenía que los sistemas de la empresa parecían seguros.

"Tomamos en serio estas afirmaciones", dijo el portavoz, agregando: "Hasta la fecha, no hemos visto ninguna evidencia de que esto esté conectado con un compromiso de los sistemas de OpenAI".

El alcance de la presunta violación generó preocupaciones debido a la enorme base de usuarios de OpenAI. Millones de usuarios en todo el mundo confían en las herramientas de la empresa como ChatGPT para operaciones comerciales, fines educativos y generación de contenido. Una violación legítima podría exponer conversaciones privadas, proyectos comerciales y otros datos sensibles.

Hasta que haya un informe final, siempre es recomendable tomar algunas medidas preventivas:

- Ir a la pestaña de “Configuraciones”, cerrar la sesión en todos los dispositivos conectados y habilitar la autenticación de dos factores o 2FA. Esto hace virtualmente imposible que un hacker acceda a la cuenta, incluso si se comprometen los datos de inicio de sesión y contraseñas.

- Si tu banco lo admite, entonces crea un número de tarjeta virtual para gestionar las suscripciones de OpenAI. De esta manera, es más fácil detectar y prevenir fraudes.

- Siempre mantén un ojo en las conversaciones almacenadas en la memoria del chatbot y estate atento a cualquier intento de phishing. OpenAI no solicita información personal y cualquier actualización de pago siempre se realiza a través del enlace oficial OpenAI.com.

Editado por Andrew Hayward