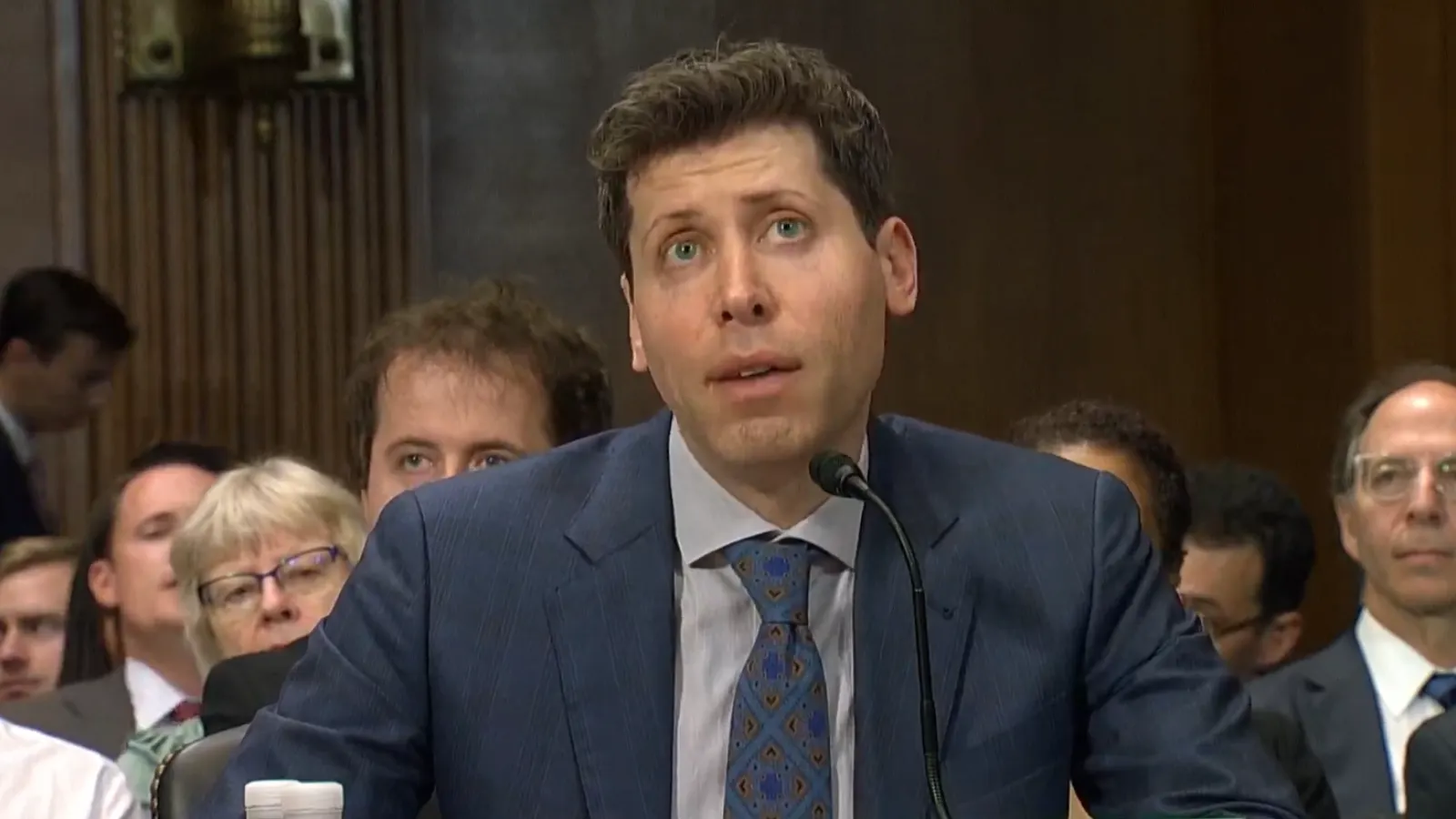

Por segunda vez este mes, el CEO de OpenAI, Sam Altman, fue a Washington para hablar de inteligencia artificial con los responsables políticos de Estados Unidos. Altman compareció ante el Comité Judicial del Senado de EE.UU. junto con la Directora de Privacidad y Confianza de IBM, Christina Montgomery, y Gary Marcus, Profesor Emérito de la Universidad de Nueva York.

Cuando el senador por Luisiana John Kennedy le preguntó cómo se debería regular la I.A., Altman dijo que se debería formar una oficina gubernamental encargada de establecer normas.

"Yo formaría una nueva agencia que concediera licencias a cualquier esfuerzo por encima de una determinada escala de capacidades, y que pudiera tomar esa licencia y garantizar el cumplimiento de las normas de seguridad", dijo Altman, añadiendo que la posible agencia debería exigir auditorías independientes de cualquier tecnología de I.A..

"No sólo por parte de la empresa o de la agencia, sino de expertos que puedan decir que el modelo cumple o no los umbrales estatales y de seguridad y estos porcentajes de rendimiento en la pregunta X o Y", dijo.

Aunque Altman dijo que el gobierno debería regular la tecnología, se mostró reacio a la idea de liderar él mismo la agencia. "Me encanta mi trabajo actual", afirmó.

Utilizando a la FDA como ejemplo, el profesor Marcus dijo que la inteligencia artificial debería someterse a una revisión de seguridad similar a la que se hace con los fármacos antes de autorizar su comercialización.

"Si vas a introducir algo en 100 millones de personas, alguien tiene que tener los ojos puestos en ello", añadió el profesor Marcus.

La agencia, dijo, debe ser ágil y capaz de seguir lo que ocurre en la industria. Revisaría previamente los proyectos y también los revisaría después de que se hayan dado a conocer al mundo—con autoridad para retirar la tecnología si fuera necesario.

"Se trata de la transparencia y la explicabilidad de la Inteligencia Artificial", añadió Montgomery, de IBM. "Tenemos que definir el uso de mayor riesgo, [y] exigir cosas como evaluaciones de impacto y transparencia, exigir a las empresas que muestren su trabajo y proteger los datos utilizados para entrenar la IA en primer lugar".

Gobiernos de todo el mundo siguen lidiando con la proliferación de la inteligencia artificial en la sociedad. En diciembre, la Unión Europea aprobó una ley sobre la IA para promover la creación de "sandboxes" reguladores por parte de las autoridades públicas para probar la IA antes de su lanzamiento.

"Para garantizar un desarrollo ético y centrado en el ser humano de la inteligencia artificial en Europa, los eurodiputados aprobaron nuevas normas de transparencia y gestión de riesgos para los sistemas de Inteligencia Artificial", escribió el Parlamento Europeo.

En marzo, Italia prohibió el ChatGPT de OpenAI por motivos de privacidad. La prohibición se levantó en abril, después de que OpenAI modificara su configuración de privacidad para permitir a los usuarios optar por que no se utilicen sus datos para entrenar al chatbot y desactivar su historial de chat.

"A la pregunta de si necesitamos una agencia independiente, creo que no queremos ralentizar la regulación para abordar los riesgos reales en este momento", continuó Montgomery, añadiendo que ya existen autoridades reguladoras que pueden regular en sus respectivos ámbitos.

Reconoció, eso sí, que esos organismos reguladores carecen de recursos suficientes y de las competencias necesarias.

"La IA debe regularse en el punto de riesgo, esencialmente", dijo Montgomery. "Y ése es el punto en el que la tecnología se encuentra con la sociedad".