En Resumen

- OpenAI lanzó GPT-4.1, Mini y Nano con ventanas de contexto de hasta un millón de tokens y mejoras de precisión y costo.

- GPT-4.1 superó a GPT-4o en codificación, generó una app web desde un archivo de 450.000 tokens y siguió instrucciones al pie de la letra.

- La compañía descontinuará GPT-4.5 tras el lanzamiento, mientras el caos en la nomenclatura de modelos continúa con versiones como o3 mini-high.

OpenAI presentó GPT-4.1 el lunes, un trío de nuevos modelos de IA con ventanas de contexto de hasta un millón de tokens—suficiente para procesar bases de código completas o pequeñas novelas de una vez. La línea incluye las variantes estándar GPT-4.1, Mini y Nano, todas dirigidas a desarrolladores.

La última oferta de la compañía llega apenas semanas después del lanzamiento de GPT-4.5, creando una cronología que tiene tanto sentido como el orden de lanzamiento de las películas de Star Wars. "La decisión de nombrarlos 4.1 fue intencional. Es decir, no es solo que seamos malos poniendo nombres", dijo Kevin Weil, líder de producto de OpenAI durante el anuncio—pero todavía estamos tratando de averiguar cuáles fueron esas intenciones.

GPT-4.1 muestra capacidades bastante interesantes. Según OpenAI, alcanzó un 55% de precisión en el benchmark de codificación SWEBench (superior al 33% de GPT-4o) mientras costaba un 26% menos. La nueva variante Nano, anunciada como el "modelo más pequeño, más rápido y más económico" de la compañía, funciona a solo 12 centavos por millón de tokens.

Además, OpenAI no cobrará extra por procesar documentos masivos y realmente utilizar el contexto de un millón de tokens. "No hay aumento de precio para contextos largos", enfatizó Kevin.

Los nuevos modelos muestran mejoras de rendimiento impresionantes. En una demostración en vivo, GPT-4.1 generó una aplicación web completa que podía analizar un archivo de registro de servidor de la NASA de 1995 de 450.000 tokens. OpenAI afirma que el modelo pasa esta prueba con casi 100% de precisión incluso con millones de tokens de contexto.

Michelle, líder de investigación post-entrenamiento de OpenAI, también mostró las capacidades mejoradas de los modelos para seguir instrucciones. "El modelo sigue todas tus instrucciones al pie de la letra", dijo, mientras GPT-4.1 cumplía obedientemente con requisitos de formato complejos sin la tendencia habitual de la IA de "interpretar creativamente" las direcciones.

Cómo no se debe contar: Guía de OpenAI para nombrar sus modelos

El lanzamiento de GPT-4.1 después de GPT-4.5 se siente como ver a alguien contar "5, 6, 4, 7" con cara seria. Es el último capítulo en la extraña saga de versiones de OpenAI.

Después de lanzar GPT-4, actualizó el modelo con capacidades multimodales. La compañía decidió llamar a ese nuevo modelo GPT-4o ("o" por "omni"), un nombre que también podría leerse como "cuatro cero" dependiendo de la fuente que uses.

Luego, OpenAI introdujo un modelo enfocado en razonamiento que simplemente se llamó "o". Pero no confundas el GPT-4o de OpenAI con el o de OpenAI porque no son lo mismo. Nadie sabe por qué eligieron este nombre, pero como regla general, GPT-4o era un Large Language Model (LLM) "normal" mientras que OpenAI o1 era un modelo de razonamiento.

Unos meses después del lanzamiento de OpenAI o1, llegó OpenAI o3.

¿Pero qué hay de o2? Bueno, ese modelo nunca existió.

"Lógicamente, podrías pensar que (nuestro nuevo modelo) tal vez debería haberse llamado o2, pero por respeto a nuestros amigos de Telefónica—y en la gran tradición de OpenAI siendo realmente muy mala con los nombres—se llamará o3", dijo Sam Altman durante el anuncio del modelo.

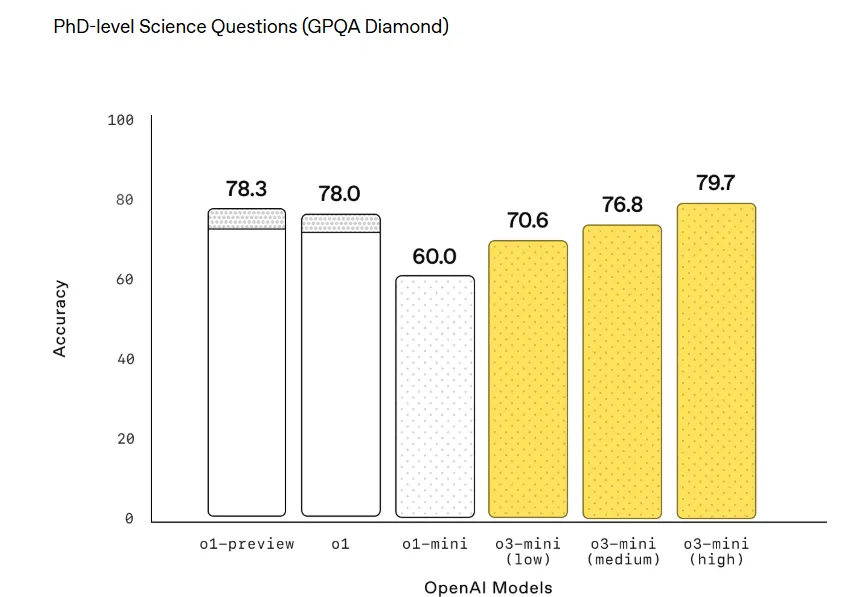

La alineación se fragmenta aún más con variantes como el o3 normal y una versión más pequeña y eficiente llamada o3 mini. Sin embargo, también lanzaron un modelo llamado "OpenAI o3 mini-high" que pone dos antónimos absolutos uno al lado del otro porque la IA puede hacer cosas milagrosas. En esencia, OpenAI o3 mini-high es una versión más potente que o3 mini, pero no tan potente como OpenAI o3—que es referenciado en un único gráfico por OpenAI como "o3 (Medium)", como debería ser. En este momento, los usuarios de ChatGPT pueden seleccionar OpenAI o3 mini u OpenAI o3 mini high. La versión normal no se encuentra por ninguna parte.

Aunque no queremos confundirte más, OpenAI ya anunció planes para lanzar o4 pronto. Pero, por supuesto, no confundas o4 con 4o porque no son para nada iguales: o4 razona—4o no lo hace.

Ahora, volvamos al recién anunciado GPT-4.1. El modelo es tan bueno que va a matar a GPT-4.5 muy pronto, haciendo de ese modelo el LLM de más corta duración en la historia de ChatGPT. "Estamos anunciando que vamos a descontinuar GPT-4.5 en la API", declaró Kevin, dando a los desarrolladores un plazo de tres meses para cambiar. "Realmente necesitamos esas GPUs de vuelta", añadió, confirmando que ni siquiera OpenAI puede escapar de la escasez de silicio que está plagando la industria.

A este ritmo, es probable que veamos GPT-π o GPT-4.√2 antes de que termine el año—pero hey, al menos mejoran con el tiempo, sin importar los nombres.

Los modelos ya están disponibles a través de API y en el playground de OpenAI, y no estarán disponibles en la interfaz de usuario amigable de ChatGPT—al menos no todavía.

Editado por James Rubin