En Resumen

- Elon Musk anunció que Grok-3, la próxima versión de su chatbot de IA, se lanzará en semanas y afirmó que ha superado a todos los modelos actuales en pruebas de rendimiento.

- Grok-3 fue entrenado con datos sintéticos y autocorrección lógica, utilizando 100,000 GPUs Nvidia H100 en el superclúster Colossus de xAI, superando en poder a su predecesor.

- A pesar de sus avances en razonamiento, Grok aún está por detrás de modelos como GPT y DeepSeek en rankings de IA, pero xAI planea expandir su infraestructura a 1 millón de GPUs.

Elon Musk anunció que la próxima generación del chatbot de IA de su compañía, Grok, podría estar a solo semanas de su lanzamiento, describiéndolo como "aterradoramente inteligente" y afirmando que ya ha superado a todos los demás modelos de IA en las pruebas.

El CEO de xAI hizo estas declaraciones durante la Cumbre Mundial de Gobiernos en Dubái el 13 de febrero.

"A veces, creo que Grok-3 es algo aterradoramente inteligente", dijo Musk. "Propone soluciones que ni siquiera anticiparías, ya sabes, soluciones no obvias".

Los desarrolladores del chatbot utilizaron métodos únicos de entrenamiento para Grok-3. En lugar de usar datos del mundo real como ChatGPT, Grok-3 se basó en datos sintéticos y empleó un mecanismo de autocorrección para mantener la consistencia lógica. Se volvió tan preciso que, incluso cuando encontraba información incorrecta, el sistema reflexionaba sobre los datos y eliminaba el contenido que no coincidía con la realidad, afirmó Musk.

Las demandas computacionales para entrenar Grok-3 fueron masivas. Los expertos calculan que requirió 200 millones de horas GPU, eclipsando los 2,7 millones de horas de su competidor chino DeepSeek-V3. Se ejecutó en el superclúster Colossus de xAI con 100.000 GPUs Nvidia H100, diez veces más potencia de cómputo que su predecesor. Incluso sin ajustes, Musk afirmó que el modelo base funcionó mejor que Grok-2.

Cool!

And Grok 3 is coming soon. Pretraining is now complete with 10X more compute than Grok 2. https://t.co/54j81EEOF5

— Elon Musk (@elonmusk) January 4, 2025

La integración de Grok-3 con X, la plataforma de redes sociales de Musk, le dio la ventaja de poder extraer datos de la aplicación en tiempo real en lugar de depender de la navegación web. El sistema puede extraer datos en tiempo real de X, y cuenta con lo que la compañía llamó "Modo Desenfrenado", que, según el FAQ de xAI, está "destinado a ser objetable, inapropiado y ofensivo".

Sin embargo, el sistema no está del todo listo para su lanzamiento. Musk comparó el trabajo restante con terminar una casa: "Ese último 5% donde haces el panel de yeso, pintas y haces el acabado, aunque no es mucho trabajo, transforma la casa".

Sin embargo, podría lanzarse antes que GPT-4.5 de OpenAI, al menos, que Sam Altman dijo que podría lanzarse en semanas o meses.

"Probablemente (Grok-3) se lance en aproximadamente una o dos semanas", dijo Musk. Aunque no aclaró si la nueva versión estaría disponible públicamente o detrás de una suscripción, como sucedió con Grok-2 al principio.

La competencia en el espacio de la IA se ha intensificado. Mientras ChatGPT dominó la cuota de mercado en 2024, el modelo de código abierto chino DeepSeek-V3 emergió como un serio competidor, superando tanto a GPT-4o como a Llama 3.1 de Meta a pesar de usar muchos menos recursos.

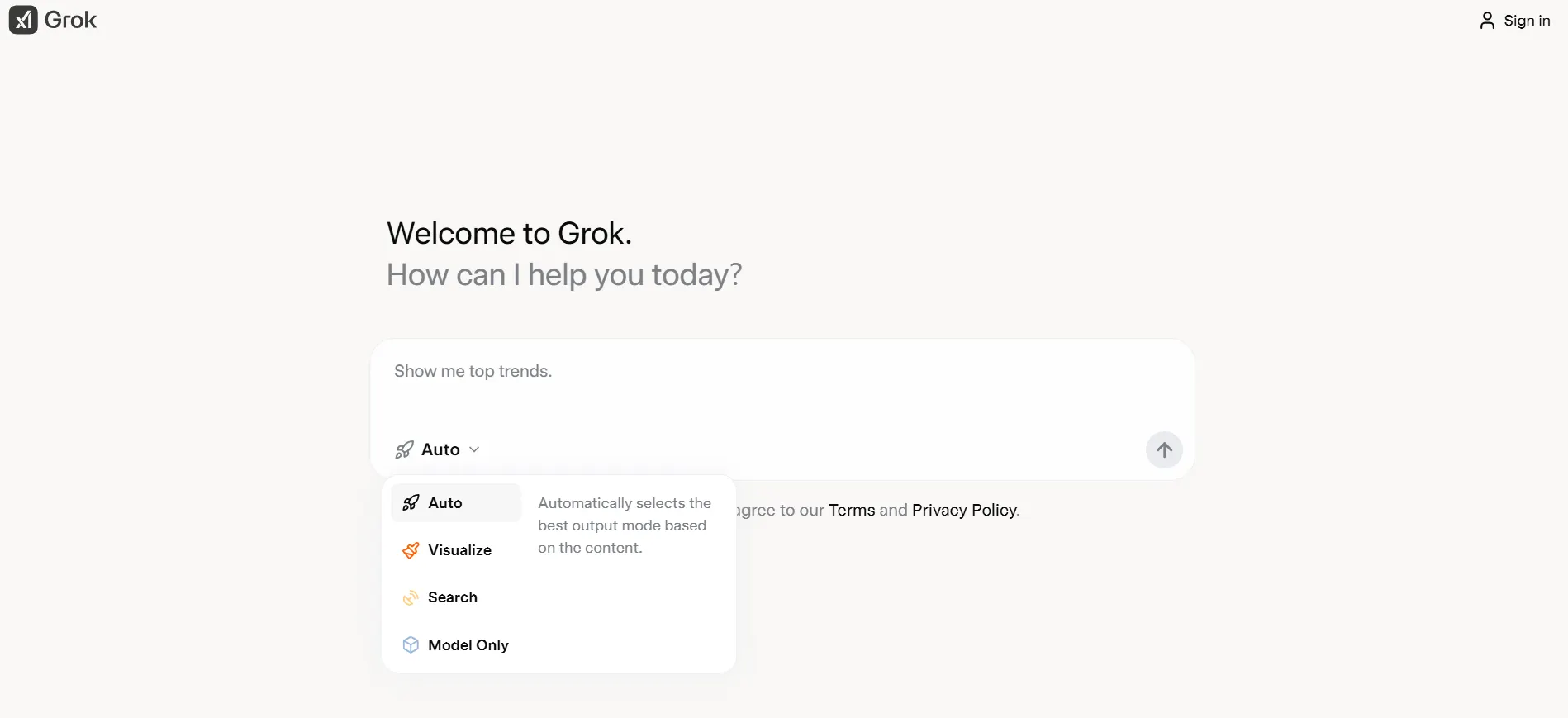

Grok se priorizó en X Premium, lo que limitó sustancialmente su disponibilidad. Posteriormente, fue lanzado de manera gratuita para todos los usuarios de la plataforma de redes sociales de Musk, con un nuevo sitio web independiente que está disponible para todos.

xAI entra en la batalla de razonamiento de la IA

Los principales actores de IA están cambiando su enfoque hacia modelos de razonamiento, desarrollando modelos de IA capaces de reflexionar sobre problemas específicos y encontrar formas de resolverlos después de un largo y extenso razonamiento en cadena.

La idea fue explorada por primera vez por Matt Schumer, cuando se anunció Reflection 70b. El modelo fue entrenado para incorporar razonamiento Chain of Thought, y se suponía que superaría a Claude 3.5 Sonnet en tareas complejas, a pesar de ser solo un ajuste fino de Llama 70b.

I'm excited to announce Reflection 70B, the world’s top open-source model.

Trained using Reflection-Tuning, a technique developed to enable LLMs to fix their own mistakes.

405B coming next week - we expect it to be the best model in the world.

Built w/ @GlaiveAI.

Read on ⬇️: pic.twitter.com/kZPW1plJuo

— Matt Shumer (@mattshumer_) September 5, 2024

Eso no funcionó, pero solo unas semanas después, OpenAI anunció su modelo de razonamiento "OpenAI o1", aplicando ese mismo concepto de manera efectiva. Ese modelo marcó un nuevo estándar en términos de las capacidades lógicas que los modelos de IA pueden exhibir, y fue visto como el foso de OpenAI para dominar la industria de IA.

Pero el lanzamiento de DeepSeek puso el mundo al revés. Un equipo de investigadores chinos construyó un modelo que era mejor que o1 a una fracción del costo, y además lo hizo de código abierto.

Desde entonces, OpenAI anunció que sus futuros modelos se fusionarían en una IA todoterreno que deja atrás la arquitectura tradicional GPT y se centra primero en el razonamiento profundo.

xAI parece estar siguiendo los mercados.

"Grok-3 tiene capacidades de razonamiento muy poderosas", dijo Elon Musk.

Sin embargo, el magnate de los automóviles eléctricos no reveló información adicional sobre la estructura del modelo. La versión actual de Grok-2 está ubicada en la posición 18 en LLM Arena, muy por debajo de competidores como GPT, Claude, Gemini, Qwen o DeepSeek.

Mirando hacia adelante, xAI planea escalar su infraestructura de cómputo a 1 millón de GPUs para futuros modelos con "billones de parámetros". El objetivo final, según Musk, es avanzar hacia la inteligencia artificial general a través de modelos cada vez más sofisticados.

Editado por Andrew Hayward.