En Resumen

- DeepSeek, la startup china de IA, ha sacudido la industria con su modelo de código abierto DeepSeek-R1, rivalizando con OpenAI a una fracción del costo.

- Su modelo, entrenado con solo $6 millones y 50.000 GPUs, compite con proyectos de miles de millones de dólares de empresas como OpenAI y Google.

- Aunque elogiado por su eficiencia, DeepSeek enfrenta críticas por posibles vínculos con el gobierno chino y preocupaciones sobre privacidad y seguridad de datos.

DeepSeek es el nuevo modelo de IA que está causando sensación en el mundo. La startup china ha impresionado al sector tecnológico con su robusto Large Language Model (LLM), construido con tecnología de código abierto.

DeepSeek también ha sacudido la industria de la IA, demostrando que es posible desarrollar una poderosa IA por millones en hardware y entrenamiento, cuando empresas estadounidenses como OpenAI, Google y Microsoft han invertido miles de millones.

¿Qué es DeepSeek?

DeepSeek es la creación del inversor y emprendedor Liang Wenfeng, un ciudadano chino que estudió información electrónica e ingeniería de comunicación en la Universidad de Zhejiang. Liang comenzó su carrera en IA utilizándola para trading cuantitativo, cofundando el fondo de cobertura High-Flyer Quantitative Investment Management en Hangzhou, China, en 2015. En 2023, Liang lanzó DeepSeek, enfocándose en avanzar la inteligencia artificial general.

DeepSeek lanzó su primer Large Language Model (LLM), DeepSeek-Coder, el 29 de noviembre de 2023.

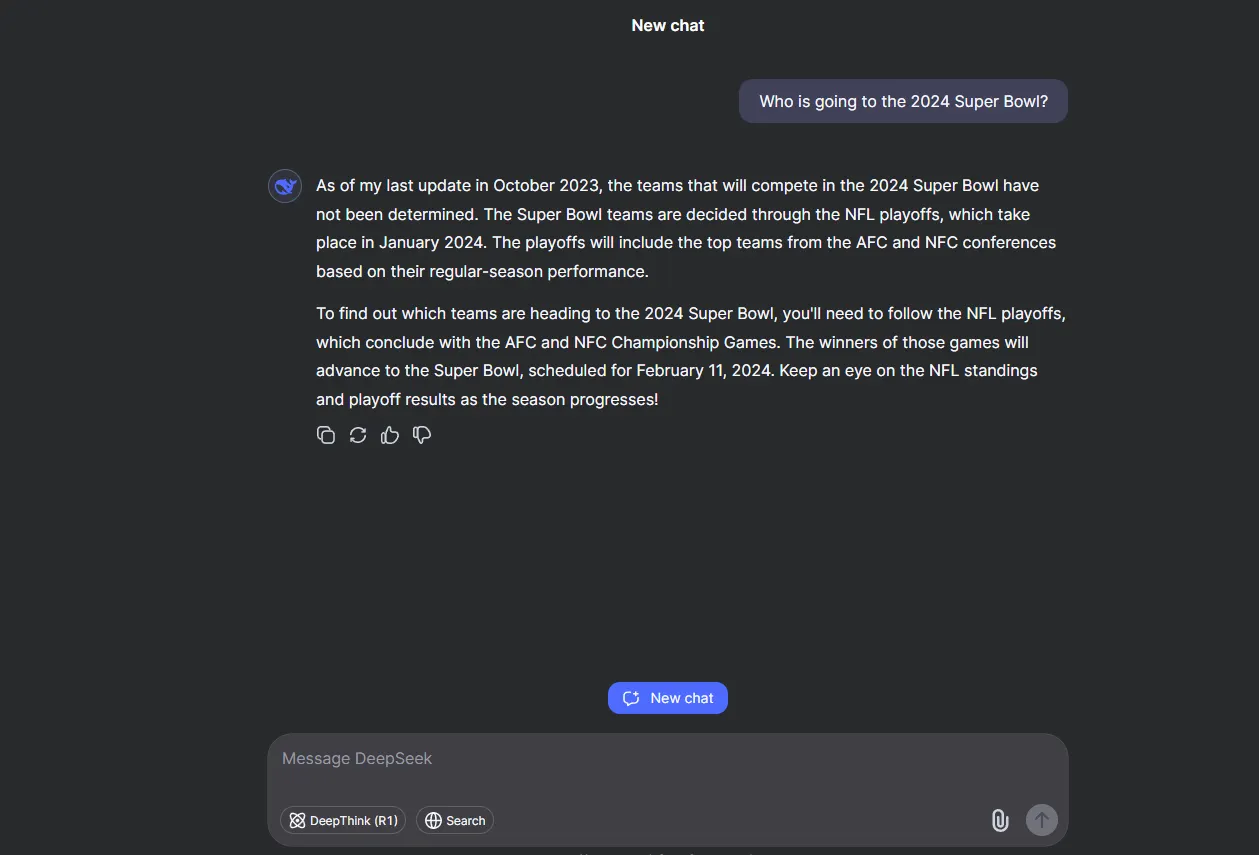

Pero no fue hasta el 20 de enero de 2025, con el lanzamiento de DeepSeek-R1, que la compañía revolucionó la industria de la IA.

Con un equipo de solo 200 personas y un presupuesto de $6 millones, DeepSeek lanzó su modelo gratuito de código abierto, que estaba a la par con el aclamado modelo GPT 01 de OpenAI, un proyecto que costó hasta $600 millones y requirió un estimado de 3.500 personas durante dos años para construirlo.

🚀 DeepSeek-R1 is here!

⚡ Performance on par with OpenAI-o1

📖 Fully open-source model & technical report

🏆 MIT licensed: Distill & commercialize freely!🌐 Website & API are live now! Try DeepThink at https://t.co/v1TFy7LHNy today!

🐋 1/n pic.twitter.com/7BlpWAPu6y

— DeepSeek (@deepseek_ai) January 20, 2025

A diferencia de las grandes empresas tecnológicas con grandes nóminas en Occidente, DeepSeek optimizó su contratación para enfocarse en estudiantes recién graduados: “Tres a cinco años de experiencia laboral es el máximo, y aquellos con más de ocho años de experiencia laboral son básicamente rechazados”, dijo un cazatalentos a 36kr, un popular sitio tecnológico chino.

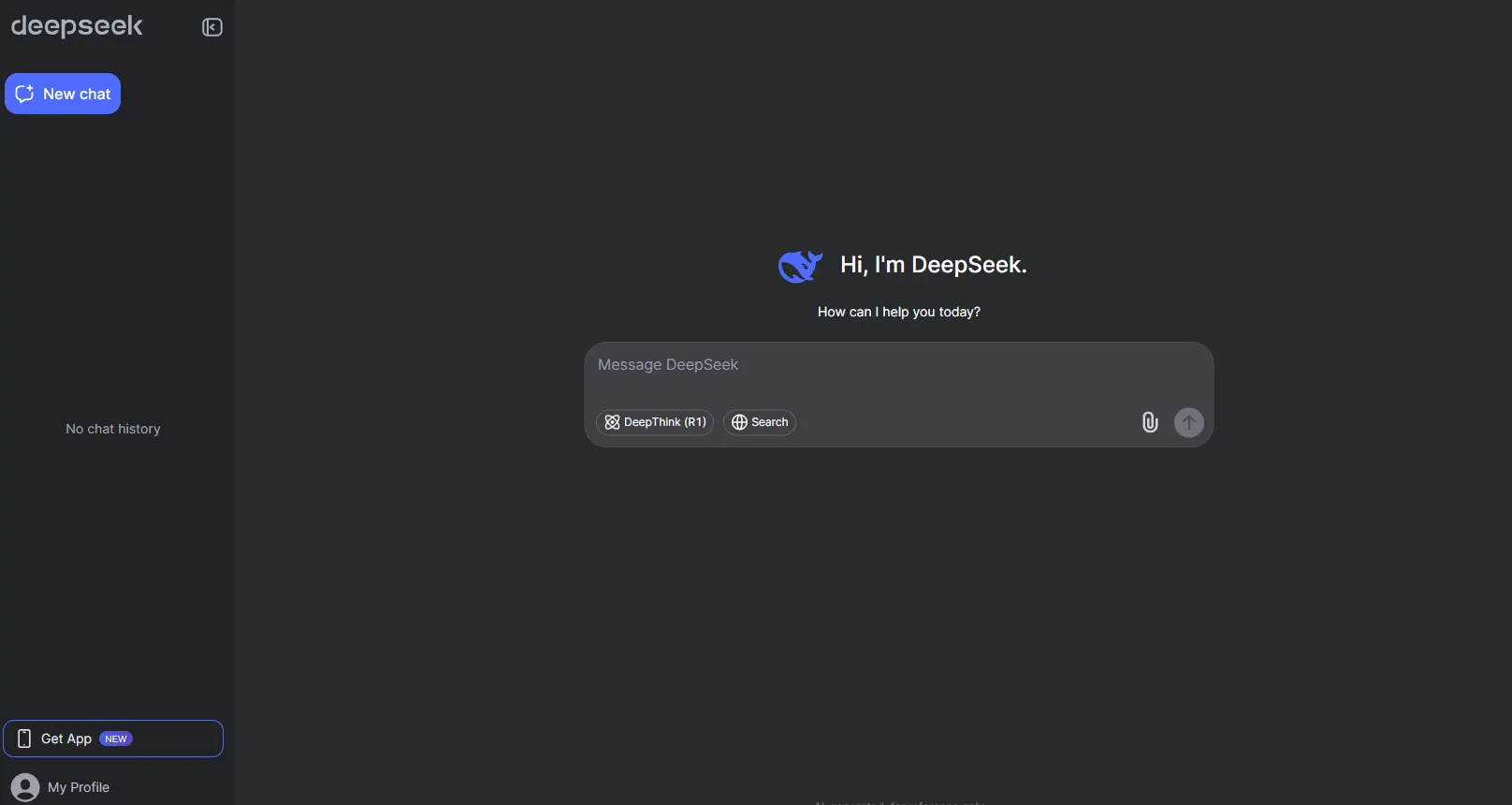

Y, mientras que OpenAI y otros modelos dominantes de IA estaban disponibles principalmente como productos de suscripción, el código de DeepSeek es de código abierto, disponible para escrutinio público y se puede descargar a una computadora local a través del playground o mercado de IA Huggingface o como una aplicación móvil, de forma gratuita.

La tecnología subyacente de DeepSeek fue considerada un avance masivo en IA y su lanzamiento envió ondas de choque a través del sector tecnológico estadounidense, eliminando $1 billón en valor en un día.

¿Qué tiene de especial DeepSeek?

El éxito de DeepSeek proviene de su enfoque en el diseño y entrenamiento del modelo. Como una supercomputadora masivamente paralela que divide las tareas entre muchos procesadores para trabajar en ellas simultáneamente, el sistema Mixture-of-Experts de DeepSeek activa selectivamente solo alrededor de 37.000 millones de sus 671.000 millones de parámetros para cada tarea. Este enfoque mejora significativamente la eficiencia, reduciendo los costos computacionales mientras aún ofrece un rendimiento de primer nivel en todas las aplicaciones.

DeepSeek mejora su proceso de entrenamiento utilizando Group Relative Policy Optimization, una técnica de aprendizaje por refuerzo que mejora la toma de decisiones comparando las elecciones de un modelo con las de agentes de aprendizaje similares. Esto permite que la IA refine su razonamiento de manera más efectiva, produciendo datos de entrenamiento de mayor calidad.

DeepSeek también ha demostrado un compromiso con la accesibilidad de código abierto al lanzar sus modelos bajo la licencia MIT, que permite a los usuarios descargar, implementar y personalizar el modelo de IA, distinguiéndolo de los competidores que mantienen sistemas cerrados y propietarios. El código abierto también permite a los desarrolladores mejorar y compartir su trabajo con otros que luego pueden construir sobre ese trabajo en un ciclo interminable de evolución y mejora.

El desarrollo de DeepSeek es ayudado por un arsenal de chips Nvidia A100 combinado con hardware menos costoso. Algunas estimaciones sitúan el número de chips Nvidia a los que DeepSeek tiene acceso en alrededor de 50.000 GPUs, en comparación con las 500.000 que OpenAI usó para entrenar ChatGPT.

Reacciones a DeepSeek

Muchos tecnólogos de IA han elogiado el modelo poderoso, eficiente y de bajo costo de DeepSeek, mientras que los críticos han planteado preocupaciones sobre la privacidad y seguridad de los datos.

“Estamos viviendo en una línea temporal donde una empresa no estadounidense mantiene viva la misión original de OpenAI: investigación de frontera verdaderamente abierta que empodera a todos. “No tiene sentido”, escribió el Dr. Jim Fan, gerente senior de investigación de Nvidia, en X (anteriormente Twitter). “El resultado más entretenido es el más probable”.

This is the DeepSeek R1 Reasoning Engine running Grok-1 Open Source.

The Reasoning Engine allows for new life to be given to older models.

It is absolutely fascinating how it works.

Look in and see: pic.twitter.com/FErN8TrOF8

— Brian Roemmele (@BrianRoemmele) January 28, 2025

Incluso el CEO de OpenAI, Sam Altman, reconoció que DeepSeek es impresionante.

“¡Obviamente entregaremos modelos mucho mejores y también es legítimamente vigorizante tener un nuevo competidor!”, dijo Altman en X.

Sin embargo, días después, la firma afirmó haber encontrado evidencia de que DeepSeek usó modelos propietarios de OpenAI para entrenar su propio modelo rival.

Los críticos también han planteado preguntas sobre los términos de servicio de DeepSeek, las prácticas de ciberseguridad y los posibles vínculos con el gobierno chino. Otros han destacado la extensa cantidad de datos de usuarios recopilados por DeepSeek, incluyendo modelos de dispositivos, sistemas operativos, patrones de pulsaciones de teclas y direcciones IP, datos que se almacenan en los servidores basados en China de DeepSeek, según la política de privacidad de la firma.

As a general news and also security awareness:

Deepseek is a new LLM and it's powerful, but there is a caveat, they collect keystroke patterns, this is not common and can be used to identify yourself in the future in any device or website as keystroke patterns are like individual… pic.twitter.com/8pn1EkzN2K— Raphael de Monticello (@RaphaMonticello) January 23, 2025

“La privacidad es un problema porque es China. Siempre se trata de recopilar datos de los usuarios. “Así que el usuario debe tener cuidado”, dijo Kevin Surace, CEO de Appvance, desarrollador de software de IA, a Decrypt. “Obligará a todos a repensar cómo entrenamos modelos y cuánta potencia se requiere para la inferencia”.

¿Qué depara el futuro para DeepSeek?

El rápido ascenso de DeepSeek desafía el dominio de los gigantes tecnológicos occidentales y plantea preguntas significativas sobre el futuro de la IA: quién la construye, quién la controla y qué tan abierta y asequible debe ser para todos.

Pero quedan preguntas sobre las implicaciones a largo plazo de DeepSeek y si el Presidente de EE.UU. Donald Trump, responderá al aparente dominio repentino de China en el sector de la IA con una prohibición al estilo de TikTok. ¿High-Flyer tergiversó su uso de GPUs para hacer que DeepSeek pareciera más eficiente de lo que realmente es? ¿El repentino lanzamiento público de DeepSeek fue programado para reducir las acciones de Nvidia en beneficio de inversores bien posicionados?

Mientras los competidores, incluyendo Meta y Perplexity AI, se apresuran a adaptarse a la metodología de DeepSeek, el impacto total de este avance en IA sigue siendo incierto. Pero una cosa está clara: DeepSeek sacudió la industria tecnológica, demostrando una vez más que, a veces, las limitaciones de recursos fuerzan avances innovadores y que la tecnología poderosa se puede construir sin etiquetas de precio de miles de millones de dólares.