En Resumen

- Illustrious dominó la comunidad de arte IA en tres meses y obligó a Civitai a crear una categoría dedicada a su ecosistema.

- Onoma AI entrenó el modelo con etiquetas Danbooru para lograr una mejor comprensión de conceptos visuales sin prompts largos.

- Illustrious alcanzó altas resoluciones y capacidades de ajuste fino, convirtiéndose en un referente en generación de imágenes de anime.

Illustrious, un modelo de texto a imagen basado en Stable Diffusion XL, se ha vuelto tan dominante en la comunidad de arte de IA que Civitai, el mayor centro de modelos de arte de IA, tuvo que crear una categoría separada solo para manejar su enorme ecosistema de recursos.

Y todo sucedió en tres meses. ¿El secreto detrás de su éxito? Un regreso a lo básico con un giro.

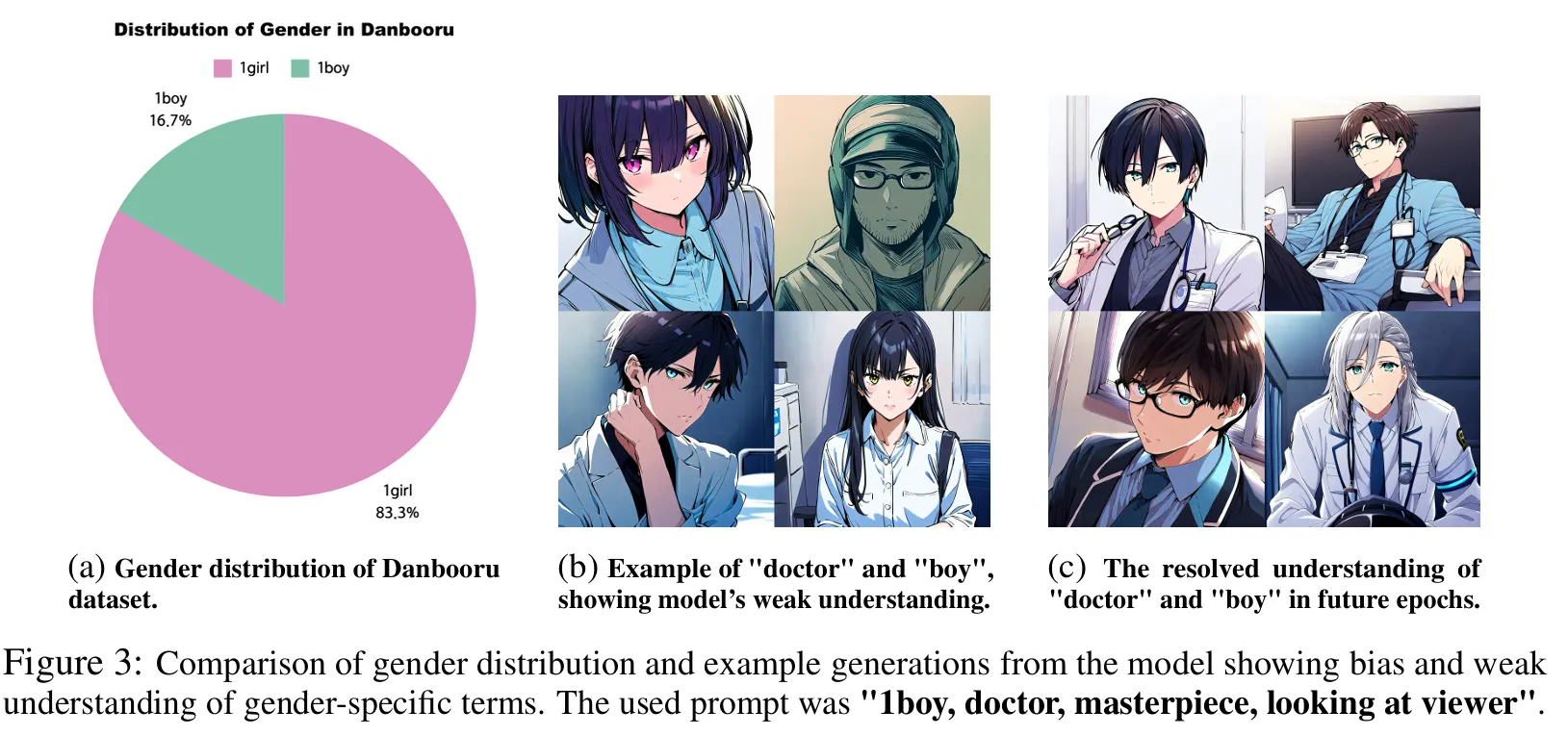

Mientras que modelos más nuevos como SD 3.5 y Flux se basan en prompts largos de lenguaje natural, Onoma AI, los desarrolladores de Illustrius, tomaron un enfoque diferente al aprovechar las etiquetas Danbooru para ayudar a su modelo a comprender conceptos sin tener que reinventar la rueda con sistemas de subtitulado complejos.

El entrenamiento del modelo en la vasta biblioteca de imágenes de anime etiquetadas de Danbooru le otorga una ventaja en la comprensión de conceptos visuales.

Cada etiqueta en el sistema Danbooru representa elementos específicos como rasgos de personajes, prendas de vestir, poses o fondos, lo que permite un control preciso sobre las imágenes generadas sin desperdiciar tokens preciosos en descripciones largas.

Estas etiquetas han estado presentes durante años y se han convertido en una especie de estándar para la categorización de imágenes entre los entusiastas del arte/anime.

El modelo es altamente preciso y eficiente cuando se trata de entender las características de una foto.

"Es como tener un artista que comprende exactamente lo que deseas sin tener que explicarlo en párrafos", dijo Vishnu, un miembro de Discord que participa en un servidor centrado en contenido de IA para adultos, a Decrypt. "Solo necesitas conocer las etiquetas correctas."

En su núcleo, Illustrious utiliza la buena y vieja arquitectura SDXL con un sofisticado sistema de doble codificador que combina CLIP ViT-L y OpenCLIP ViT-bigG para comprender palabras y asociarlas con su equivalente visual.

El modelo es capaz de procesar y generar imágenes a una impresionante resolución de 1.536×1.536, con la capacidad de ampliarse hasta 2.048×2.048 e incluso 3.744x3.744 sin una pérdida significativa de calidad.

Para contextualizar, el SDXL original manejaba resoluciones Full HD (1.024x1.024).

Profundizando en Illustrious

El proceso para crear Illustrious fue metódico y deliberado. La fase de entrenamiento inicial, que produjo la versión 0.1, procesó 7,5 millones de imágenes a una resolución de 1.024×1.024 con un tamaño de lote de 192 imágenes por lote.

El equipo equilibró cuidadosamente las tasas de aprendizaje, ejecutando durante 20 epochs o épocas (el proceso en el que la IA estudia el 100% de su conjunto de datos) para establecer una base sólida. Una vez que los resultados fueron lo suficientemente satisfactorios, el equipo procedió a aumentar el tamaño del conjunto de datos y las resoluciones utilizadas para las siguientes iteraciones.

En la fase avanzada de entrenamiento, Illustrious realmente comenzó a brillar. La versión 1.0 amplió el conjunto de datos a 10 millones de imágenes y aumentó la resolución a 1.536×1.536.

Aunque redujeron el tamaño del lote a 128, introdujeron estrategias sofisticadas de manipulación de etiquetas y tokens de registro, cambios fundamentales que definieron el rendimiento excepcional del modelo.

La fase final de refinamiento para la versión 2.0 llevó las cosas un poco más lejos. Trabajando con 20 millones de imágenes en la misma alta resolución, pero con un tamaño de lote más grande de 512, el equipo incorporó un método multi-caption que mejoró drásticamente la correspondencia texto-imagen.

El resultado fue el mejor generador de waifu conocido por el hombre, con buenas capacidades de ajuste fino, adhesión al prompt, estética decente y salidas de alta calidad.

Para los más entendidos en tecnología, los desarrolladores de Illustrious también introdujeron muchas técnicas interesantes como el enfoque de "Token sin deserción" o “No Dropout Token”, asegurando que tokens específicos nunca sean excluidos durante el entrenamiento; la implementación de "Quasi-Register Tokens", para que el modelo sea capaz de manejar conceptos desconocidos o extraños; un Cosine Annealing Scheduler, para la tasa de aprendizaje; un sistema de Multi-Level Dropout system and Input Perturbation Noise Augmentation, para convertir un modelo de IA simple en una potencia.

Cómo usar Illustrious

Illustrious no necesita pasos adicionales para ejecutarse.

El proceso de instalación es el mismo que con cualquier otro Modelo SDXL. Descarga el punto de control y colócalo en la carpeta correspondiente, dependiendo de qué interfaz de usuario uses.

Windows y Linux

- Para ComfyUI, la ruta es \models\checkpoints.

- Para A1111/Forge, la ruta es \models\checkpoints.

- Para Fooocus, la ruta también es \models\checkpoints.

MacOS

Los usuarios de Mac tienen rutas similares. Sin embargo, algunas interfaces de usuario populares orientadas a macOS requieren pasos adicionales.

- Los usuarios de Draw Things tendrán que hacer clic en "Models", ir a "Customize" y luego hacer clic en "Import Model".

- A partir de ahí, pueden ingresar la URL para descargar Illustrious directamente o hacer clic en "Import Custom Model" para seleccionar el archivo si descargaron el modelo y lo guardaron en sus unidades locales.

- Los usuarios de Diffusion Bee deben hacer clic en el ícono de hamburguesa en la esquina superior derecha, luego hacer clic en "Settings" y después en "Add new model", y seleccionar su punto de control illustrious descargado localmente.

Una vez que el modelo esté cargado, hay tres cosas a considerar.

- No utilizar lenguaje natural. Recuerda depender de las etiquetas de Danbooru y seguir el antiguo estilo de prompt SDXL para obtener mejores resultados.

- No utilizar Pony LoRas. Dado que el modelo utiliza enfoques diferentes, es mejor utilizar Illustrious Loras para obtener los mejores resultados.

- Intenta no utilizar el modelo original Illustrious, en su lugar elige algunos de los finetunes más populares. El modelo original Illustrious es un modelo base, perfecto para finetunes que se centran en los resultados que deseas lograr. Es lo mismo que SDXL, Pony o Flux. Los finetunes tienden a producir mejores resultados.

Los mejores modelos de Illustrious para elegir

Hay muchos modelos para elegir, todos enfocados en diferentes estilos, estéticas y características.

Incluso hay modelos generales como los de Noob AI que utilizaron Illustrious como base y están siendo utilizados por afinadores para construir sus modelos.

Sin embargo, aquí están nuestras mejores opciones para diferentes necesidades. Estos son excelentes en comprensión de prompts, calidad de salida y facilidad de uso. Todas las muestras son de la comunidad de Civit AI y son de libre uso.

Más Versátil: Mistoon_Anime

Enlace: Mistoon_Anime - v1.0 Illustrious | Punto de control Illustrious | Civitai

Mejor para 2.5d: Smooth Mix - Illustrious — ¡Advertencia! Muy orientado a contenido para adulto

Enlace: Smooth Mix - Illustrious | Pony - Illustrious | Illustrious Checkpoint | Civitai

Mejor para Arte e Ilustraciones: NTR Mix

Enlace: NTR MIX | illustrious-XL | Noob-XL - XIII | Illustrious Checkpoint | Civitai

Mejor para Realismo: THRILLustrious

THRILLustrious - v5.0 Emocionado | Punto de control ilustre | Civitai

Editado por Sebastian Sinclair y Josh Quittner