En Resumen

- Investigadores de la Universidad de Stanford han desarrollado agentes de IA capaces de predecir el comportamiento humano con una precisión del 85% tras entrevistas de dos horas.

- Estos clones digitales, basados en un análisis multidimensional de entrevistas, pueden replicar patrones de toma de decisiones y rasgos de personalidad, reduciendo sesgos raciales e ideológicos.

- Este avance plantea desafíos éticos, ya que la creación de gemelos digitales funcionales podría reemplazar a personas en el trabajo, lo que abre un debate sobre el impacto de la IA en el empleo y la identidad.

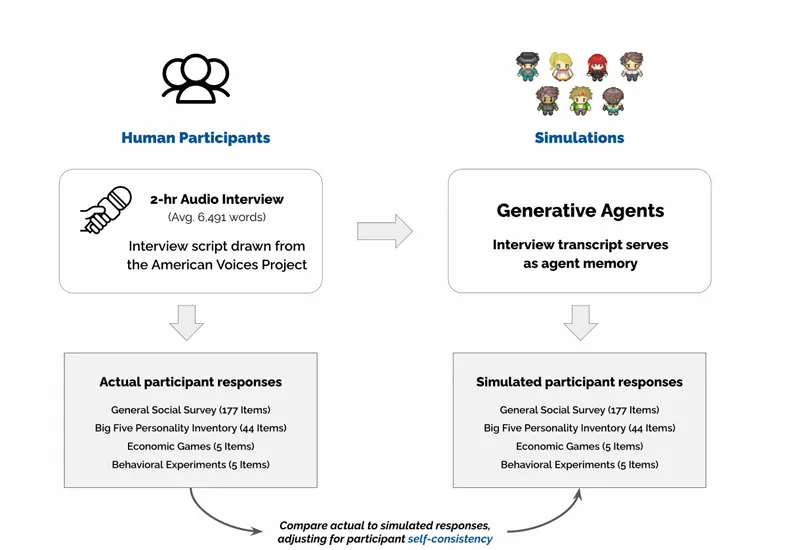

Investigadores de la Universidad de Stanford han desarrollado agentes de IA que pueden predecir el comportamiento humano con una precisión notable. Un estudio reciente, dirigido por el Dr. Joon Sung Park y su equipo, demuestra que una entrevista de dos horas proporciona suficientes datos para que la IA replique patrones de toma de decisiones humanas con una precisión normalizada del 85%.

Los clones digitales de una persona física van más allá de los deepfakes o las "adaptaciones de bajo rango" conocidas como LoRAs. Estas representaciones precisas de personalidades podrían usarse para perfilar usuarios y probar sus respuestas a varios estímulos, desde campañas políticas hasta propuestas de políticas, evaluaciones de estado de ánimo e incluso versiones más realistas de los avatares de IA actuales.

El equipo de investigación reclutó a 1.052 estadounidenses, cuidadosamente seleccionados para representar diversas demografías en edad, género, raza, región, educación e ideología política. Cada participante participó en una conversación de dos horas con un entrevistador de IA, produciendo transcripciones que promediaban 6.491 palabras. Las entrevistas, siguiendo una versión modificada del protocolo American Voices Project, exploraron las historias de vida, valores y perspectivas de los participantes sobre temas sociales actuales.

Y eso es todo lo que necesitas para ser perfilado y tener un clon.

Pero a diferencia de otros estudios, los investigadores tomaron un enfoque diferente para procesar los datos de las entrevistas. En lugar de simplemente alimentar transcripciones sin procesar en sus sistemas, desarrollaron un módulo de "reflexión experta". Esta herramienta de análisis examina cada entrevista a través de múltiples lentes profesionales: la perspectiva de un psicólogo sobre rasgos de personalidad, la visión de un economista conductual sobre patrones de toma de decisiones, el análisis de posturas ideológicas de un politólogo y la interpretación contextual de un experto en demografía.

Una vez que se completa este análisis multidimensional, la IA es más capaz de comprender adecuadamente cómo funciona la personalidad del sujeto, obteniendo una comprensión más profunda de lo que se podría lograr simplemente tratando de predecir el comportamiento más probable basado en estadísticas. El resultado es un grupo de agentes de IA impulsados por GPT-4 con la capacidad de replicar el comportamiento humano en diferentes escenarios controlados.

Las pruebas resultaron notablemente exitosas. "Los agentes generativos replican las respuestas de los participantes en la Encuesta Social General con una precisión del 85% en comparación con cómo los participantes replican sus propias respuestas dos semanas después, y tienen un rendimiento comparable en la predicción de rasgos de personalidad y resultados en Replicaciones experimentales", dice el estudio. El sistema mostró una destreza similar en la replicación de los rasgos de personalidad Big Five, logrando una correlación de 0.78, y demostró una precisión significativa en juegos de toma de decisiones económicas con una correlación normalizada de 0.66. (Un coeficiente de correlación de 1 indicaría una correlación positiva perfecta).

Particularmente notable fue el sesgo reducido del sistema entre grupos raciales e ideológicos en comparación con los enfoques tradicionales basados en demografía, lo que parece ser un problema para muchos sistemas de IA, que luchan por encontrar un equilibrio entre estereotipar (asumir que un sujeto exhibiría rasgos del grupo en el que está incluido) y ser excesivamente inclusivo (evitar suposiciones fácticas estadísticas/históricas para ser políticamente correcto).

"Nuestra arquitectura reduce los sesgos de precisión entre grupos raciales e ideológicos en comparación con los agentes a los que se les dan descripciones demográficas", enfatizaron los investigadores, sugiriendo que su método basado en entrevistas podría ser muy útil en el perfilado demográfico.

Pero este no es el primer esfuerzo por usar IA para perfilar personas.

En Japón, la plataforma CLONEdev de alt Inc. ha estado experimentando con la generación de personalidad a través de la integración de datos de lifelog. Su sistema combina procesamiento avanzado del lenguaje con generación de imágenes para crear clones digitales que reflejan los valores y preferencias de los usuarios. "A través de nuestra tecnología P.A.I, estamos comprometidos a trabajar hacia la digitalización de toda la raza humana", dijo alt Inc. en una publicación de blog.

Y a veces ni siquiera necesitas una entrevista personalizada. Toma a MileiGPT como ejemplo. Un investigador de IA de Argentina pudo ajustar finamente un LLM de código abierto con miles de horas de contenido disponible públicamente y replicar los patrones de comunicación y procesos de toma de decisiones del Presidente de Argentina, Javier Milei. Estos avances han llevado a los investigadores a explorar la idea de "gemelos digitales" pensantes/sentientes, que analistas tecnológicos y expertos como Rob Enderle creen que podrían ser completamente funcionales en los próximos 10 años.

Y por supuesto, si los robots de IA no te quitan el trabajo, probablemente lo hará tu gemelo de IA. "La emergencia de estos necesitará una gran cantidad de pensamiento y consideración ética, porque una réplica pensante de nosotros mismos podría ser increíblemente útil para los empleadores", dijo Enderle a la BBC. "¿Qué pasa si tu empresa crea un gemelo digital de ti y dice, 'Oye, tienes este gemelo digital al que no le pagamos salario, entonces ¿por qué te seguimos empleando a ti?'"

Las cosas pueden parecer un poco aterradoras. No solo los deepfakes imitarán tu apariencia, sino que los clones de IA podrán imitar tus decisiones basándose en un breve perfilado de tu comportamiento. Si bien los investigadores de Stanford se han asegurado de implementar salvaguardas, está claro que la línea entre la identidad humana y digital se está volviendo cada vez más borrosa. Y ya la estamos cruzando.