En Resumen

- Una encuesta en curso a más de 100.000 personas reveló que los entusiastas de la inteligencia artificial prefieren trabajar con herramientas de código abierto en lugar de las comerciales propietarias.

- El modelo de código abierto Mixtral 8x7B de Mistral AI ha tenido un impacto significativo en el espacio de la inteligencia artificial, superando a modelos comerciales propietarios en la clasificación de Chatbot Arena.

- Mixtral, basado en la arquitectura de 'Mezcla de Expertos' (MoE), ha destacado por su rendimiento en varias pruebas de referencia y su competencia multilingüe.

Los entusiastas de la inteligencia artificial prefieren trabajar con herramientas de código abierto en lugar de las comerciales propietarias, según una encuesta en curso de más de 100.000 encuestados.

La aparición del modelo de código abierto Mixtral 8x7B de Mistral AI ha tenido un impacto significativo en el espacio de la IA. Ligero y potente, Decrypt lo incluyó entre los Mejores LLMs de 2023. Mixtral ha llamado la atención por su notable rendimiento en varias pruebas de referencia, especialmente en Chatbot Arena, que ofrece un enfoque único centrado en el ser humano para evaluar LLMs.

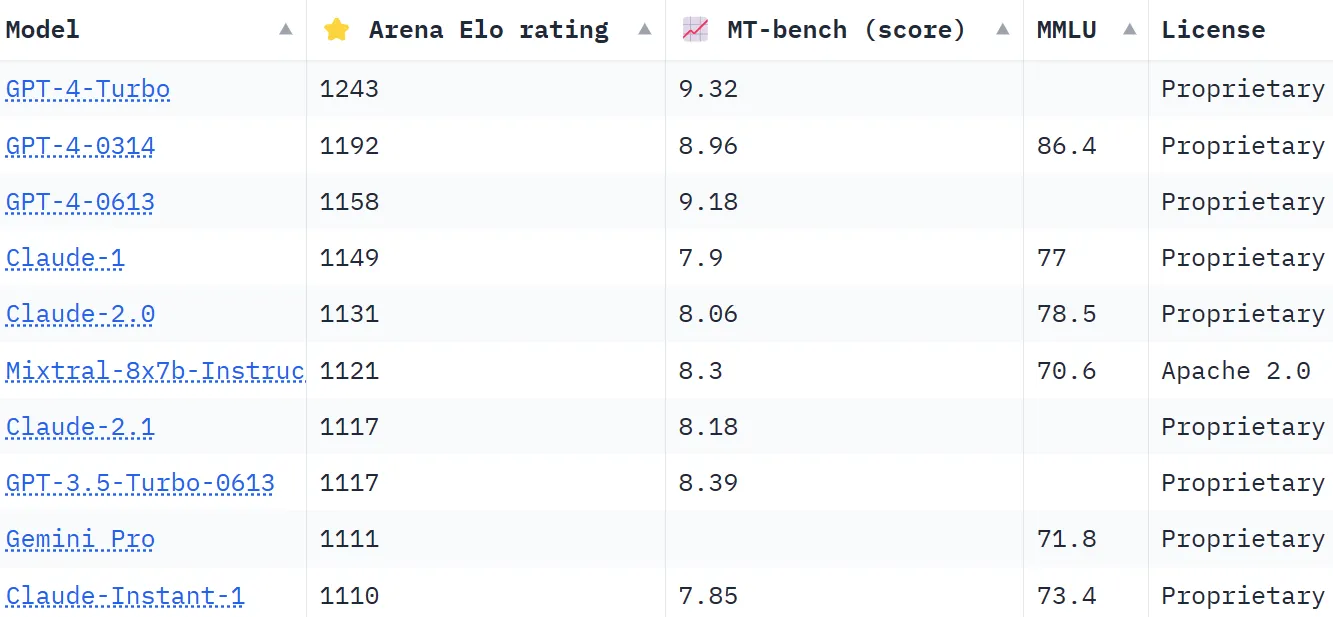

La clasificación de Chatbot Arena, una lista colaborativa, aprovecha más de 130.000 votos de usuarios para calcular las clasificaciones Elo de los modelos de IA. En comparación con otros métodos que intentan estandarizar los resultados para que sean más objetivos, Arena opta por un enfoque más "humano", pidiendo a las personas que elijan entre dos respuestas proporcionadas por LLMS no identificados a ciegas. Estas respuestas pueden parecer poco convencionales según ciertos estándares, pero pueden ser evaluadas intuitivamente por usuarios humanos reales.

Mixtral tiene una posición impresionante, superando a gigantes de la industria como Claude 2.1 de Anthropíc, GPT-3.5 de OpenAI, que alimenta la versión gratuita de ChatGPT, y Gemini de Google, un LLM multimodal que se vendió como el chatbot más poderoso para desafiar el dominio de GPT-4.

Una de las diferencias destacadas de Mixtral es ser el único LLM de código abierto en el top 10 de la Arena de Chatbots. Esta distinción no es solo una cuestión de clasificación; representa un cambio significativo en la industria de la IA hacia modelos más accesibles y basados en la comunidad.

Como informó Decrypt, Mistral AI dijo que su modelo "supera a LlaMA 2 70B en la mayoría de los puntos de referencia con una inferencia 6 veces más rápida y coincide o supera a GPT 3.5 en la mayoría de los puntos de referencia estándar", como MMLU, Arc-C o GSM.

El secreto detrás del éxito de Mixtral radica en su arquitectura de 'Mezcla de Expertos' (MoE). Esta técnica utiliza múltiples modelos virtuales de expertos, cada uno especializado en un tema o campo específico. Cuando se enfrenta a un problema, Mixtral selecciona los expertos más relevantes de su grupo, lo que conduce a resultados más precisos y eficientes.

"En cada capa, para cada token, una red de enrutamiento elige dos de estos grupos (los 'expertos') para procesar el token y combinar su salida de manera aditiva", explicó Mistral en el reciente artículo publicado en LLM. "Esta técnica aumenta el número de parámetros de un modelo al tiempo que controla el costo y la latencia, ya que el modelo solo utiliza una fracción del conjunto total de parámetros por token."

Además, Mixtral se destaca por su competencia multilingüe. El modelo sobresale en idiomas como francés, alemán, español, italiano e inglés, mostrando su versatilidad y su amplio potencial. Su naturaleza de código abierto, bajo la licencia Apache 2.0, permite a los desarrolladores explorar, modificar y mejorar el modelo libremente, fomentando un entorno colaborativo e innovador.

El éxito de Mixtral claramente no se trata solo de habilidades tecnológicas; marca una pequeña pero importante victoria para la comunidad de IA de código abierto. Quizás, en un futuro no tan lejano, la pregunta no será sobre qué modelo llegó primero, o cuál tiene más parámetros o capacidades de contexto, sino cuál realmente resuena con las personas.

Editado por Ryan Ozawa.