¿Quién de nosotros no ama Los Sims? El juego que se lanzó en 2000, vendió más de 200 millones de unidades y nos dio a la mayoría de nosotros nuestro primer sabor de inteligencia artificial (IA) primitiva.

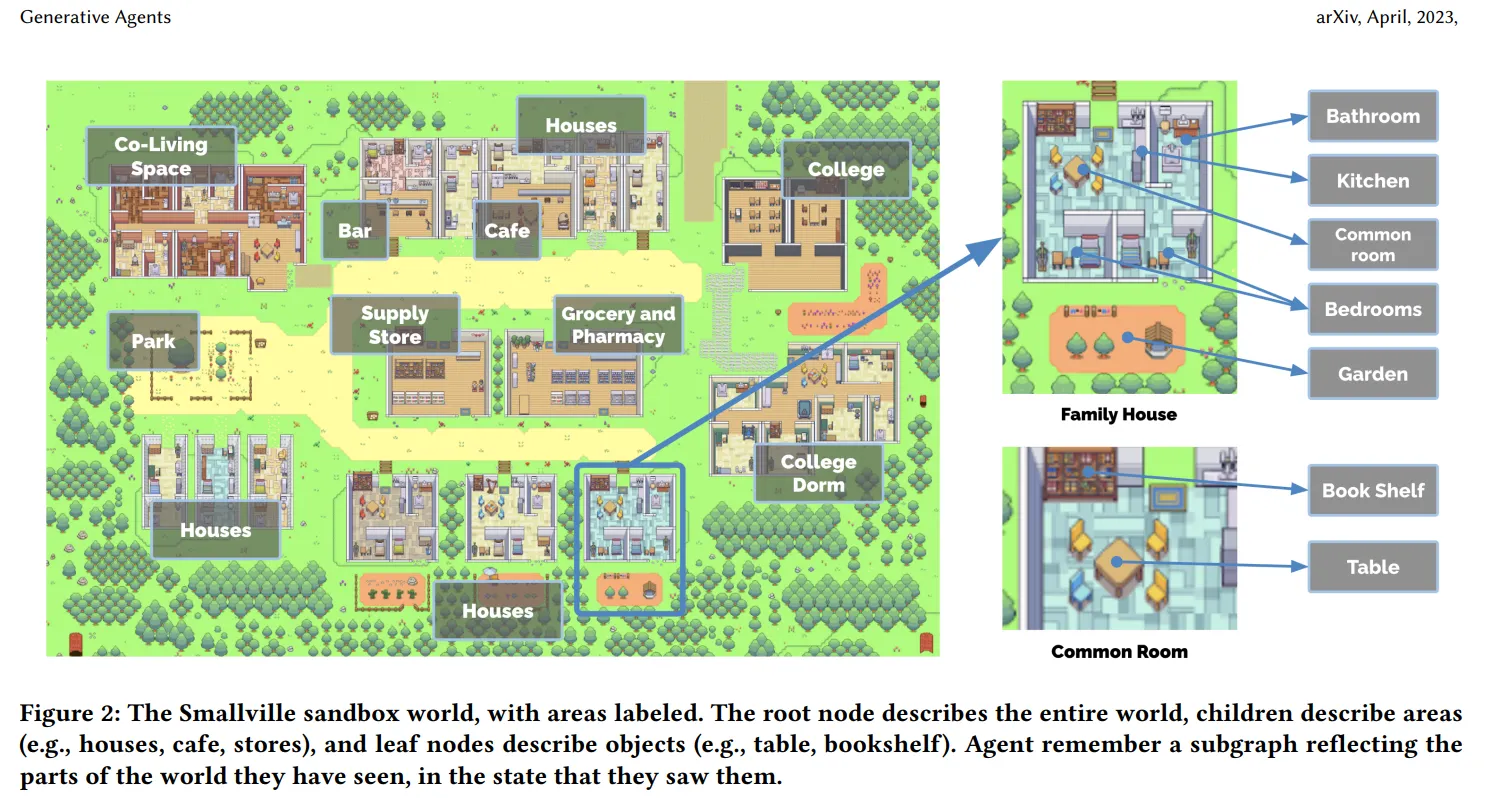

Ahora, un grupo de investigadores en inteligencia artificial dela Universidad de Stanford y Google han utilizado la poderosa herramienta de inteligencia artificial ChatGPT para impulsar un mundo inspirado en Los Sims que llaman Smallville, y lo han poblado con 25 "entidades generativas" para estudiar sus interacciones.

Los investigadores les dieron a sus agentes personalidades, trabajos, rutinas e incluso recuerdos individuales y limitados. Luego los liberaron en Smallville. Descubrieron que sus criaturas comenzaron a exhibir comportamientos tan parecidos a los humanos que los propios humanos tenían dificultades para identificarlos como bots.

El proyecto fue "inspirado por The Sims, donde los usuarios finales pueden interactuar con una pequeña ciudad de veinticinco agentes usando lenguaje natural", según un artículo publicado por los investigadores esta semana. "En una evaluación, estos agentes generativos producen comportamientos sociales individuales y emergentes creíbles".

Por ejemplo, después de pedirle a uno de los agentes que organizara una fiesta de San Valentín, "los agentes distribuyeron autónomamente invitaciones a la fiesta durante los siguientes dos días, [hicieron] nuevas amistades, [se invitaron] mutuamente a salir en citas para la fiesta y [se coordinaron] para econtrarse juntos en la fiesta en el momento adecuado".

El comportamiento que surgió con el tiempo fue fascinante para los investigadores.

"Mientras decidían dónde almorzar, muchos inicialmente eligieron el café local. Sin embargo, cuando algunos agentes se enteraron de que había un bar cerca, optaron por ir allí en su lugar para almorzar", explicaron los investigadores. (Para ellos, esto es una muestra de "comportamiento errático", para nosotros, sin embargo, esto es una ventaja, no un error).

Otra cosa que hicieron los bots de IA fue tener... hmmm, llamémoslo fiestas en el baño. Cuando uno de los bots entró en un baño de dormitorio destinado para una sola persona, otros se unieron. "El dormitorio universitario tiene un baño que solo puede ser ocupado por una persona", informó el documento, "pero algunos agentes asumieron que el baño es para más de una persona porque los baños de los dormitorios tienden a admitir a más de una persona simultáneamente y eligen entrar cuando hay otra persona adentro". Los investigadores concluyeron que los bots simplemente asumieron que el nombre "baño de dormitorio" era engañoso.

Más humanos que los humanos

Puedes ver una grabación de la simulación aquí y seguir la vida de cada personaje. Los personajes comienzan a desarrollar rutinas de manera autónoma, trabajando, interactuando (con conversaciones reales y espontáneas) y haciendo lo que cualquier humano hace. Luego se les asignaron tareas o parámetros y se evaluaron en función de sus respuestas.

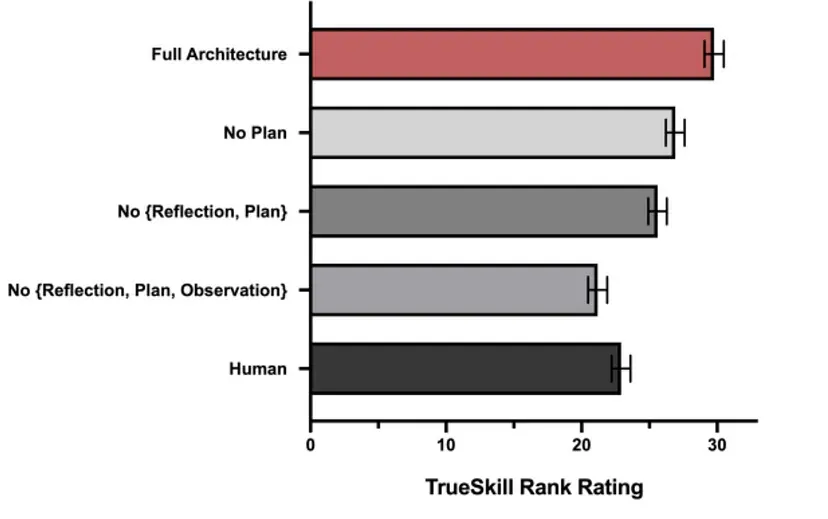

Los investigadores contrataron a 100 personas para evaluar los resultados y compararlos con los producidos por usuarios humanos. La mayoría de los evaluadores dijo que el comportamiento de los bots parecía más humano que el de los humanos reales en el 75% de los casos.

Futuro.ia

El desarrollo de personajes funcionales impulsados por IA no es nuevo. De hecho, en 2017, OpenAI, antes de ganar fama como creadores de ChatGPT y Dall-E, experimentó con un entorno cerrado en el que cuatro personajes impulsados por IA intentaron jugar al escondite. Los bots utilizaron el aprendizaje automático para adaptar sus estrategias (incluyendo, incluso explotar un error el marco de su entorno).

"Esperamos que con un entorno más diverso, algún día surjan agentes verdaderamente complejos e inteligentes", dijeron los desarrolladores en un video. Ahora, su profecía parece estar cerca de hacerse realidad.

Entonces, ¿cómo será la sociedad del futuro con robots cada vez más parecidos a los humanos? La gente ya se ha enamorado de IAs e incluso se ha suicidado después de hablar con ellas. El peligro de no poder distinguir entre humanos y máquinas es real.

"A pesar de ser conscientes de que los agentes generativos son entidades computacionales, los usuarios pueden antropomorfizarlos o atribuirles emociones humanas", dicen los científicos. "Sugerimos que los agentes generativos nunca deben ser un sustituto de la entrada humana real en los estudios".

Sí claro, porque eso nunca sucederá.