En Resumen

- Guns N' Roses utilizó inteligencia artificial generativa en su último video musical para "The General", creado por Creative Works London.

- Originalmente concebido como animación en Unreal Engine, el director creativo del video adoptó la IA generativa Stable Diffusion para acelerar y mejorar el proceso creativo.

- La IA generativa crea imágenes inquietantes y oníricas, transformando cada cuadro y aportando una estética única al video, demostrando su potencial en la producción artística.

Los videos musicales han sido durante mucho tiempo bancos de pruebas para nuevas tecnologías, desde los personajes en 3D que pueblan "Money for Nothing" de Dire Straits hasta las técnicas pioneras de CGI utilizadas en "Black or White" de Michael Jackson.

Ahora, la icónica banda de hard rock Guns N' Roses ha incorporado la inteligencia artificial generativa en su último video para acompañar su nueva canción "The General".

La banda recurrió a Creative Works London, el estudio que ha producido, desde animaciones para sus shows en vivo hasta videos musicales.

"The General" sigue a un niño pequeño por las calles de un inquietante paisaje urbano de tonos magenta mientras es amenazado por juguetes de la infancia que adquieren un aspecto amenazante.

Según el director creativo de Creative Works London, Dan Potter, el video originalmente fue concebido como un video completamente animado en Unreal Engine. Aproximadamente seis semanas después de comenzar la producción, el mánager de la banda le envió un enlace al concurso de inteligencia artificial generativa DiffuseTogether de Peter Gabriel.

"Había estado siguiendo eso", dijo, agregando que había estado "jugando" con la plataforma de IA generativa Stable Diffusion desde su lanzamiento en 2022. "Así que cuando me lo envió, fue como, 'Oh, ya estoy ahí, ya sé lo que se necesita para lograr ese tipo de trabajo".

Este amor por la IA

"Me fui bajo tierra por un tiempo, literalmente durante cinco días", dijo Potter. "Entré en mi estudio y comencé a explorar todo lo relacionado con el uso de todo lo que hemos hecho hasta ahora en Unreal Engine: dándole la estética, dándole el movimiento, dándole la historia, dándole a la IA todas las ideas que habíamos desarrollado en esas seis semanas".

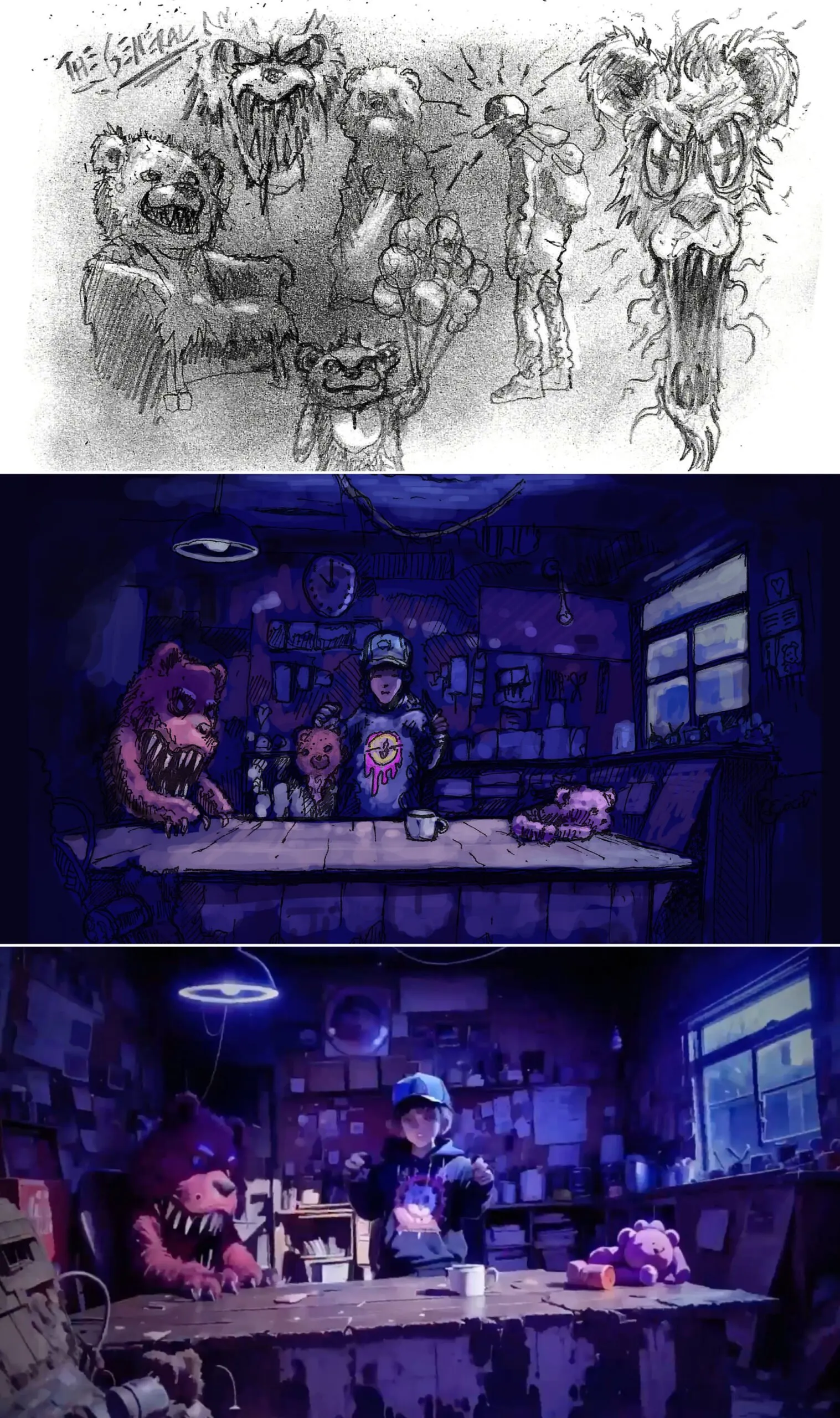

Creative Works London desarrolló un "tipo de flujo de trabajo híbrido", dijo Potter, utilizando bocetos conceptuales y metraje de Unreal Engine como punto de partida para que Stable Diffusion trabajara antes de "controlar la vibra y la apariencia con las indicaciones".

Potter agregó que entrenó una hiperred (o red neuronal de apoyo) en Stable Diffusion con el trabajo anterior del estudio para Guns N' Roses para ayudar a capturar el estilo visual de la banda. "Pude tomar algunos de mis bocetos y pintarlos y llevarlos a otro nivel", explicó Potter, agregando que "la inteligencia artificial está acelerando mi proceso [creativo] de manera exponencial".

"Le estaba alimentando el metraje de Unreal Engine de varias formas", explicó. "Lo alimenté como una capa sobre la que soñaba, y también como un punto de partida para soñar el resto de la visualización".

Calle de los Sueños

Donde la IA generativa muestra todo su potencial es en la creación de imágenes inquietantes y oníricas que se ven a lo largo del video. A medida que la cámara se mueve y se inclina, la IA "sueña" cada cuadro por separado, con elementos de fondo parpadeando y transformándose. Osos de peluche se desintegran y se reforman como sillas, ventanas se transforman en puertas y pasillos, y criaturas biomecánicas directamente de las pinturas de Hieronymus Bosch aparecen y desaparecen en el fondo antes de disolverse en sus partes constituyentes.

"Ingresar renders de Unreal Engine y luego hacer que sueñe sobre ellos, eso para mí fue un uso realmente interesante", dijo Potter. "Porque esos renders fueron creados por seis o siete personas, y luego le estábamos dando instantáneamente una vibra diferente".

Además, Potter utilizó indicaciones de Difusión Estable para convertir imágenes de acción en vivo de la banda en imágenes generadas por IA, alternando entre ambas. "Le había dado una indicación, como 'estrella de rock futurista y psicótica'", dijo, señalando una imagen de Axl Rose representado como, bueno, una estrella de rock futurista y psicótica.

Potter se esforzó por señalar que Creative Works utilizó IA generativa para mejorar la producción del estudio, en lugar de reemplazar el trabajo de los artistas. "Quería que fuera lo más parecido posible a un proceso dibujado a mano e intervenido por humanos", dijo.

Con ese fin, las imágenes generadas por Stable Diffusion se basan en el trabajo de los artistas del estudio, mientras que el video también incluye muchos toques hechos a mano, como grafitis superpuestos en la imagen, transiciones a través de una alcantarilla con el logotipo de Guns N' Roses y el logotipo de "The General" que aparece en una lata de bebida aplastada al principio.

Ese logotipo también presenta un "huevo de Pascua oculto y travieso", dijo Potter. "Simplemente, agregué la 'L', por lo que tienes la 'G', la 'N' y la 'R', y un 'A.I.' al final".

The General, our music video, for #GunsNRoses, out now, link below to the band's YouTube #design #branding #emergingtechnologies #ai #aiartcommunity #makeitlivehttps://t.co/kxL7qoMeQJ pic.twitter.com/yQ1oXo0rdV

— CreativeWorksLondon (@CreativeWorksUK) January 26, 2024

Vive y deja que la IA te ayude

Potter dijo que ve la IA como una "herramienta creativa" en lugar de un reemplazo para los artistas.

"Creo que el problema que muchos artistas tienen con la IA es que casi dice: '¡Ta-da! Ahí está tu imagen terminada'", explicó. "Y es un lugar muy peligroso para un creativo, donde piensas: 'Bueno, solo tenemos que poner una indicación y obtienes el resultado'".

Con el video de "The General", agregó: "Estaba en una posición única en la que solo yo podía hacerlo".

"Lo que quería hacer con la IA era decir: 'Si me confías algo tan controvertido, ¿quién mejor que Guns N' Roses, la banda más peligrosa del mundo, para probar la IA'?", dijo. "Porque al final del día es una herramienta creativa, quería que fuera algo que surgiera en todos los sentidos desde dentro de la banda".

Después de "The General", Creative Works London está buscando otras formas de integrar la IA en la producción de Guns N' Roses, incluyendo la combinación de la IA con iMAG, el sistema de proyección de video a gran escala utilizado en las actuaciones en vivo. "Lo que hemos estado haciendo con el espectáculo de Guns, no lo hemos logrado realmente, porque los equipos no están preparados para ello, es dejar contenido en tiempo real en el iMAG", dijo.

La idea, explicó, es "hacer que Axl interactúe con el contenido que se alimenta desde la pantalla principal, pero en el iMAG", con elementos de realidad aumentada que aparecen delante y detrás de él. "Lo que estamos tratando de hacer allí es una especie de punto intermedio, para que si estás en un espectáculo y te pones las gafas, puedas ver todo este contenido en tiempo real fluyendo alrededor de la banda".

Sugirió que en el futuro, las actuaciones en vivo podrían incorporar elementos de realidad aumentada, "donde las personas puedan simplemente usar esos lentes y luego ver el contenido explotar más allá del escenario y a su alrededor, en este tipo de alucinación similar al DMT".

En cuanto al futuro de los artistas en un mundo de IA generativa, Potter dijo: "Sentimos que le debíamos a todos decir simplemente que, 'Un equipo significativo de artistas estuvo detrás de esto y ningún artista murió haciendo esto'". Añadió que la IA "no va a matar al artista, simplemente va a amplificar y mejorar lo que ya hacemos. Diría que el futuro se trata de ser más de como la guías".

Editado por Andrew Hayward